Runwayが動画生成AIモデル「Gen-3 Alpha」をリリース、数日以内に誰でも5~10秒の動画生成が利用可能に

AI企業のRunwayが、大規模マルチモーダルトレーニング用に構築された新しいインフラストラクチャでトレーニングした、新しい動画生成AIモデルの「Gen-3 Alpha」を発表しました。

Introducing Gen-3 Alpha: A New Frontier for Video Generation

https://runwayml.com/blog/introducing-gen-3-alpha/

Runway unveils new hyper realistic AI video model Gen-3 Alpha | VentureBeat

https://venturebeat.com/ai/runway-unveils-new-hyper-realistic-ai-video-model-gen-3-alpha-capable-of-10-second-long-clips/

Gen-3 Alphaは複雑なシーンの変更、幅広いシネマティックな選択肢、詳細なアートディレクション機能を備えた動画を生成できるAIモデルです。

Introducing Gen-3 Alpha: Runway’s new base model for video generation.

— Runway (@runwayml) June 17, 2024

Gen-3 Alpha can create highly detailed videos with complex scene changes, a wide range of cinematic choices, and detailed art directions.https://t.co/YQNE3eqoWf

(1/10) pic.twitter.com/VjEG2ocLZ8

RunwayはGen-3 Alphaについて、「大規模なマルチモーダルトレーニング用に構築されたインフラストラクチャ上でRunwayがトレーニングする今後のAIモデルシリーズの最初のものであり、一般世界モデルを構築するというRunwayの目標における重要な一歩となります」と説明しました。

以下のポストに添付されている動画は「Subtle reflections of a woman on the window of a train moving at hyper-speed in a Japanese city.(日本の都市を超高速で移動する電車の窓に映る女性の微妙な表情)」というプロンプトで生成されたもの。

Gen-3 Alpha is the first of an upcoming series of models trained by Runway on a new infrastructure built for large-scale multimodal training, and represents a significant step towards our goal of building General World Models.

— Runway (@runwayml) June 17, 2024

Prompt: Subtle reflections of a woman on the window… pic.twitter.com/Lw54twUTbs

Gen-3 Alphaは動画と画像の両方でトレーニングされているため、テキストから動画を生成できるというだけでなく、画像から動画を生成したり、テキストから画像を生成したりすることも可能。この他、モーションブラシや高度なカメラコントロール機能、ディレクターツールなどのコントロール機能を今後強化していく予定とのこと。なお、Gen-3 Alphaは新しく改良されたRunwayのビジュアルモデレーション システムや、デジタルコンテンツの信ぴょう性を証明するための標準であるC2PAなどの、新しい安全対策を備えてリリースされます。

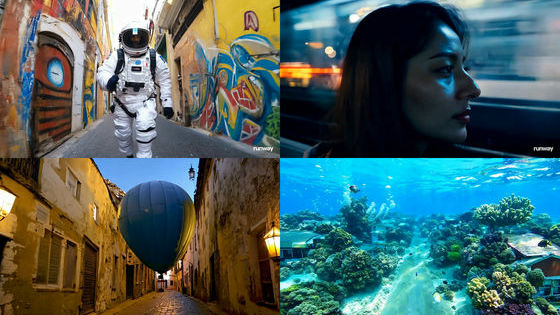

以下のポストに添付されている動画は「An astronaut running through an alley in Rio de Janeiro.(リオデジャネイロの路地を走る宇宙飛行士。)」というプロンプトで生成されたもの。

Trained jointly on videos and images, Gen-3 Alpha will power Runway's Text to Video, Image to Video and Text to Image tools, existing control modes such as Motion Brush, Advanced Camera Controls and Director Mode, and upcoming tools to enable even more fine-grained control over… pic.twitter.com/sWXIb3NXgm

— Runway (@runwayml) June 17, 2024

Gen-3 Alphaはクリエイティブな用途向けに徹底的にトレーニングされた動画生成AIモデルで、研究科学者・エンジニア・アーティストからなる学際的なチームによる共同作業であるとRunwayは強調しています。

以下のポストに添付されている動画は「FPV moving through a forest to an abandoned house to ocean waves.(森を抜けて廃屋へ、そして海の波へと移動する一人称視点)」というプロンプトで生成されたもの。

Gen-3 Alpha was trained from the ground up for creative applications. It was a collaborative effort from a cross-disciplinary team of research scientists, engineers and artists.

— Runway (@runwayml) June 17, 2024

Prompt: FPV moving through a forest to an abandoned house to ocean waves.

(4/10) pic.twitter.com/537sUxJ85A

また、RunwayはGen-3モデルファミリーの一員となるGen-3 Alphaのカスタムバージョンを、大手エンターテインメント企業やメディア組織と協力あるいは提携して開発しているそうです。Gen-3 Alphaのカスタムバージョンでは、よりスタイル制御された一貫性のあるキャラクターの生成が可能になり、特定の芸術的および物語的な要件をターゲットにすることができるとのこと。

以下のポストに添付されている動画は「 An older man playing piano, lit from the side.(横から照らされたピアノを弾く年配の男性)」というプロンプトで生成されたもの。

As part of the family of Gen-3 models, we have been collaborating and partnering with leading entertainment and media organizations to create custom versions of Gen-3 Alpha.

— Runway (@runwayml) June 17, 2024

Customization of Gen-3 models allows for even more stylistically controlled and consistent characters,… pic.twitter.com/ebfyfzGoJv

RunwayはGen-3 Alphaについて、「この技術の飛躍的進歩は、アーティストを支援し、次世代の創造的かつ芸術的な革新への道を切り開くという当社の取り組みにおいて重要なマイルストーンとなります」と言及しています。なお、Gen-3 Alphaは今後数日以内に誰でも利用できるようになるとのことです。

以下のポストに添付されている動画は「A slow cinematic push in on an ostrich standing in a 1980s kitchen.(1980年代のキッチンに立っているダチョウにゆっくりと迫る映画のようなシーン)」というプロンプトで生成されたもの。

This leap forward in technology represents a significant milestone in our commitment to empowering artists, paving the way for the next generation of creative and artistic innovation.

— Runway (@runwayml) June 17, 2024

Gen-3 Alpha will be available for everyone over the coming days.

Prompt: A slow cinematic push… pic.twitter.com/cLaZvGpeu6

以下のポストに添付されている動画は「A middle-aged sad bald man becomes happy as a wig of curly hair and sunglasses fall suddenly on his head.(中年の悲しそうなハゲ男が、巻き毛のかつらとサングラスが突然頭に落ちてきて喜ぶ)」というプロンプトで生成されたもの。

Prompt: A middle-aged sad bald man becomes happy as a wig of curly hair and sunglasses fall suddenly on his head.

— Runway (@runwayml) June 17, 2024

(7/10) pic.twitter.com/5cVSVdc9bf

以下のポストに添付されている動画は「A colossal statue of an ancient warrior stands tall on a cliff's edge. The camera circles slowly, capturing the warrior's silhouette.(古代の戦士の巨大な像が崖の端にそびえ立っています。カメラはゆっくりと回転しながら、戦士のシルエットを捉えます)」というプロンプトで生成されたもの。

Prompt: A colossal statue of an ancient warrior stands tall on a cliff's edge. The camera circles slowly, capturing the warrior's silhouette.

— Runway (@runwayml) June 17, 2024

(8/10) pic.twitter.com/4m27YkaOJ0

以下のポストに添付されている動画は「An empty warehouse, zoom in into a wonderful jungle that emerges from the ground.(空の倉庫、地面から現れる素晴らしいジャングルにズームイン)」というプロンプトで生成されたもの。

Prompt: An empty warehouse, zoom in into a wonderful jungle that emerges from the ground.

— Runway (@runwayml) June 17, 2024

(9/10) pic.twitter.com/gAUdKPDfvl

以下のポストに添付されている動画は「Handheld camera moving fast, flashlight light, in a white old wall in a old alley at night a black graffiti that spells 'Runway'(手持ちカメラが高速で移動し、懐中電灯の光が灯り、夜の古い路地の白い壁に「Runway」という黒い落書きが描かれている)」というプロンプトで生成されたもの。

Prompt: Handheld camera moving fast, flashlight light, in a white old wall in a old alley at night a black graffiti that spells 'Runway'.

— Runway (@runwayml) June 17, 2024

(10/10) pic.twitter.com/xRreX33g0r

テクノロジーメディアのVentureBeatがRunwayに確認したところによると、Gen-3 Alphaの最初のリリースでは5~10秒動画生成機能が利用できるようになっているとのこと。なお、5秒の動画を生成するのに45秒、10秒の動画を生成するのに90秒の時間がかかるそうです。RunwayはGen-3 Alphaについて、「今後数日以内に誰でも利用できるようになる」と説明していますが、VentureBeatが同社のCTOであるAnastasis Germanidis氏にインタビューして入手した情報によると、Gen-3 AlphaはまずRunwayの有料サブスクリプションユーザー向けに提供されることとなるそうです。

なお、Gen 3-Alphaのトレーニングデータに何が用いられたかは明かされていませんが、VentureBeatは「主要なAI生成モデルのほとんどがトレーニングにどのようなデータを利用しているのかを詳細には公開していません。データが有料ライセンス契約を通じて調達されたものなのか、インターネット上からスクレイピングされたものなのかも不明です」と指摘。VentureBeatはRunwayにGen-3 Alphaのトレーニングデータについて質問していますが、返ってきた回答は「当社にはすべてのトレーニングを監督する社内研究チームがあり、厳選された社内データセットを使用してモデルをトレーニングしています」というあいまいな内容だったそうです。

・関連記事

Luma AIが動画生成AIモデルの「Dream Machine」をリリース、誰でも無料で月に30本まで動画生成可能 - GIGAZINE

自動で1080p・1分超の動画を生成できるAI「Veo」をGoogleが発表 - GIGAZINE

OpenAIが動画生成AI「Sora」でどんな動画を作れるか示す作例を大量公開 - GIGAZINE

Googleが超高品質な動画生成AI「Lumiere」を発表、フレーム同士のつながりが自然で「テキストや画像から動画生成」「写真の一部を動画化」「動画の一部分を指定して加工」などなど機能てんこもり - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by logu_ii

You can read the machine translated English article Runway releases its video generation AI ….