世界で初めて反物質をトラックに乗せて輸送することに成功

欧州原子核研究機構(CERN)のBASE実験チームは92個の反陽子を閉じ込めた携帯型の装置を実験設備から切り離し、トラックに積んでCERNのメインサイト内で輸送し、その後も実験運用を継続することに成功したと2026年3月24日に発表しました。今回の輸送では約30分かけて8km超を移動し、最高時速42kmで構内を走行したとのことで、CERNは「反陽子を蓄えた可搬型トラップを実際に車両で移送し、移送後も扱える状態を保ったまま運用した点」を世界初の偉業ととらえています。

BASE experiment at CERN succeeds in transporting antimatter | CERN

https://home.cern/news/press-release/experiments/base-experiment-cern-succeeds-transporting-antimatter

Antimatter has been transported for the first time ever — in the back of CERN’s truck

https://www.nature.com/articles/d41586-026-00950-w

反物質は物質と電荷や磁気的性質が反対である以外はほぼ同一の性質を持ちますが、地球上の自然界には存在しません。CERNは反陽子を生成・保存・研究できる世界で唯一の場所であり、ADとELENAという減速器を使って低エネルギーの反陽子を各実験に供給しています。BASE実験チームはこうした反陽子の性質を高精度で測ることを目的としており、陽子との比較を通じて、なぜ宇宙に物質が多く反物質がほとんど残っていないのかという根本的な謎に迫ろうとしています。

今回の輸送が必要になったのは、CERNの反物質工場の内部では装置や機械がごく微弱な磁場の揺らぎを生み、それがノイズとなって精密測定の限界になっているためです。BASE実験チームは反陽子の固有磁気モーメントなどをより精密に測りたいと考えていますが、そのためには反陽子を建物の外に持ち出し、より静かな環境で測定する必要があります。今回の実験は、そのために反陽子を工場外部の実験室へ運び出す技術を確立する第一歩です。

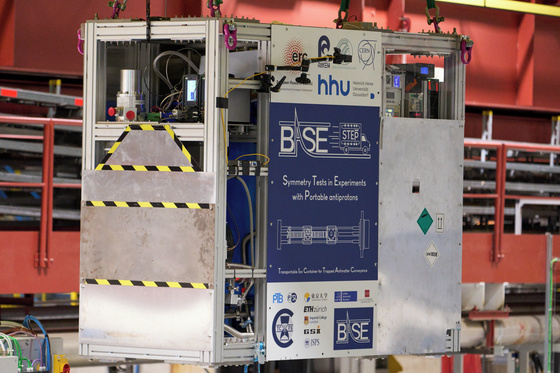

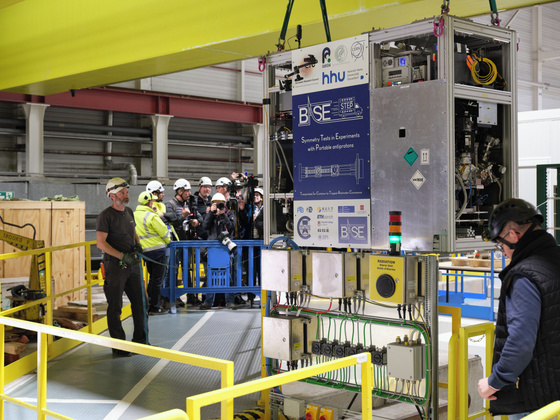

今回の成功の鍵となったのは、BASE-STEPと呼ばれる可搬型の極低温ペニング・トラップです。これは、CERNの反物質工場で作られた反陽子を磁場と電場で閉じ込めたまま保存し、そのまま別の場所へ運ぶために開発された装置で、超伝導磁石、液体ヘリウムによる極低温冷却系、予備電源、真空チャンバーなどを一体化しています。現在の装置は約1000kgで、運転中に反陽子の状態を確認するための検出系も備えています。

反陽子は物質に触れると消滅してしまうため、輸送中も高真空と極低温を維持し続ける必要がありますが、BASE-STEPはその条件を満たしたうえで、トラックに積める大きさに小型化され、通常の研究室の扉を通れるうえ、走行時の振動にも耐えられるよう設計されています。

BASE実験チームはBASE-STEPを使って100個の陽子をトラックで運ぶ実験を2025年に実施しており、成功しています。今回はそれを反陽子で実証しました。

CERNが「反物質の長距離輸送」の実現に向けて陽子をトラックで運ぶ実験に成功、100個の陽子を積載して最高時速42kmで3km以上走行し無損失の快挙 - GIGAZINE

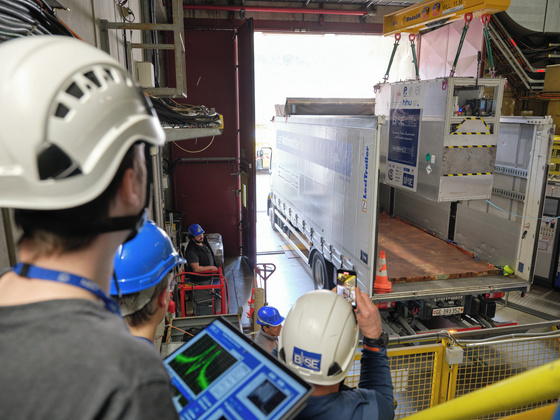

BASE-STEPをトラックに積載するところ。今回の実験では、約30分かけて8km超を移動し、最高時速42kmで反陽子を輸送することに成功しました。

今後の計画として、プロジェクトは次の段階であるBASE-STEPフェーズへと移行し、CERN内の別の建物への輸送やトラップ間での反陽子の移し替えを練習するとのこと。2029年頃にはドイツのハインリヒ・ハイネ大学デュッセルドルフ(HHU)にある新しい実験室まで、約700kmの距離を輸送することを目指しています。

700kmものの移動には8時間以上かかることが予想されるため、BASE-STEPに使われる超伝導磁石を維持できる8.2K以下の温度を保つべく、トラックに発電機を積み込んで冷却システムを常時稼働させるなどの課題も検討されています。この技術が確立されれば、世界各地の研究所で宇宙の根源的な謎に迫るための精密な実験が可能になると期待されています。

CERNの研究・計算担当ディレクター、ゴーティエ・アメル・ド・モンシュノー氏は「反物質の輸送は、先駆的かつ意欲的なプロジェクトであり、BASE実験チームとのコラボレーションによるこの素晴らしい成果を祝福します。私たちは反物質への理解をさらに深めることができる、刺激的で科学的な旅の始まりに立っています」と述べました。

・関連記事

物質と対の性質を持つ「反物質」が重力に従って落ちることがCERNの実験で判明して反重力が否定される - GIGAZINE

反物質を捕らえるレーザー冷却装置をCERNら研究チームが開発、反物質の研究が飛躍へ - GIGAZINE

CERNがLHCを用いた実験で作られた最も重い反ハイパー核「反ハイパーヘリウム4」を発見 - GIGAZINE

反物質が重力に従い落下することが明らかになったことでワープドライブ実現の最大の希望が消滅したとの指摘 - GIGAZINE

・関連コンテンツ

in サイエンス, Posted by log1i_yk

You can read the machine translated English article We succeeded in transporting antimatter ….