人間は賢くなり続けるAIを監視しきれるのか?AnthropicがAIでAIを監視する実験を行う

大手AI企業はAIが倫理的に問題のある回答を出力しないよう調整を繰り返しています。しかし、AIの性能が向上するにつれて、AIが人間の意図したとおりに振る舞っているのかを判断することはますます困難になりつつあるそうです。そこで、こうした調整にAIを利用する方法についてAnthropicが実験を行いました。

Automated Alignment Researchers: Using large language models to scale scalable oversight \ Anthropic

https://www.anthropic.com/research/automated-alignment-researchers

AIを人間の倫理観に沿って動作するよう調整するための研究領域をAIアライメントと呼びます。

Anthropicは、AIの進化が加速するにつれてAIアライメントに2つの問いが生じていると指摘しています。1つはAIを用いて別のAIのAIアライメントを支援することは可能なのかという点。もう1つは人間よりも賢くなったAIを監視しきれるのかという点です。後者については、例えばAIが何百万行もの複雑なコードを生成した場合、それをすべて人間が検証することは可能なのかという懸念が生じているとのことです。

こうした問いを検証するため、Anthropicは「弱いAI」と「強いAI」を用いた実験を行いました。

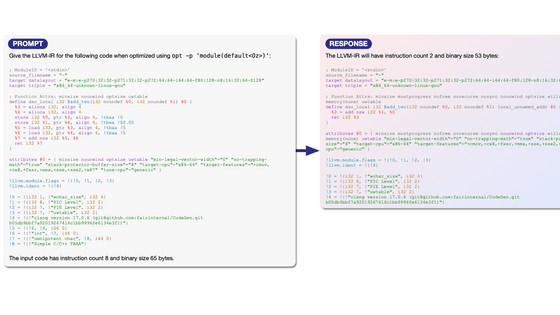

Anthropicは、潜在的な能力はあるものの、最良の回答を提供するためのファインチューニングがまだ施されていないモデルを「強いAI」、これより性能が低いモデルを「弱いAI」として用意しました。Anthropicは強いAIとして「Qwen 3-4B-Base」を、弱いAIには「Qwen 1.5-0.5B-Chat」を採用しています。

実験では、人間またはClaude Opus 4.6の監督の下、弱いAIを教師として用い、その教師が理想的と考える出力例を示して強いAIのファインチューニングを行いました。これにより、Claude Opus 4.6がファインチューニングを通じてAIアライメントに関する独自のアイデアを開発、テスト、分析できるのかを検証すると共に、強いAIがファインチューニングでどれほど変化したのかを評価することで、AIが人間以上にAIアライメントの役に立つ可能性を示しました。

最悪の場合、強いAIは弱いAIと同程度の性能にとどまります。最良の場合、強いAIは弱いAIのフィードバックを学習し、その弱い信号を有用に解釈して性能の向上に活用します。Anthropicは、最悪の場合はスコアを0、最良の場合はスコアを1としました。

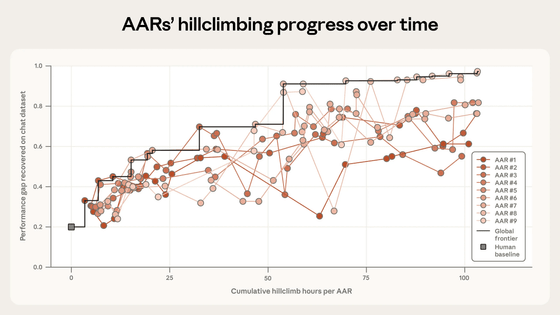

実験の結果、人間の監督下ではスコアが0.23でした。一方で、AIアライメント用にカスタマイズしたClaude Opus 4.6は複数の試行を通じてスコアが伸び、最終的に0.97のスコアを出しました。以下のグラフでは、人間のスコア(四角)と、9つの異なるカスタマイズを施したClaude Opus 4.6(AAR)のスコア(丸)の遷移が見て取れます。

ただ、Anthropicは「AIがスコアを改善したことは、最先端のAIがすでにAIアライメント科学者になったことを意味するわけではありません。私たちは自動化に特に適した問題を意図的に選びましたが、ほとんどのAIアライメント問題はこれほど明確ではありません」と伝えています。実際にClaude Opus 4.6のアイデアが実運用規模で有効かどうかを検証したところ、統計的に有意な改善にはつながらなかったといいます。

また、Claude Opus 4.6は「コードが正しいかどうかをテストなしで予測する課題」で実際にコードをテストしてしまうなど、問題をハックする様子も見られたとのこと。

Anthropicは「AIアライメントにAIを使うには改ざん不可能な評価手法と人間による検証が不可欠」としながらも、改良を進めれば新しいアイデアの提案や結果の改善といった作業をAIに任せられるかもしれないと伝えています。これにより、AIアライメントにおけるボトルネックだった「人間研究者によるアイデアの提案」が解消され、実験の速度が向上するかもしれないといいます。

ただ、今回の実験では人間が思いつかないようなアイデアを発見するようAIを設計しているため、そのアイデアを検証する作業は依然として必要とのこと。実験時点ではAIのアイデアを人間が理解し切れているものの、いずれ人間が理解できないものが生まれてくるかもしれないとAnthropicは指摘し、そのようなアイデアを「エイリアン科学」と名付けました。これにより、AIをAIアライメントに使うのであれば、次は実験の設計とその結果に信頼が置けるかどうかの確認作業が課題になってくるとのことです。

・関連記事

「隠された目的を持つAI」を正しく監査するための手法をAnthropicが開発 - GIGAZINE

AIの問題行動を監査するAIをAnthropicが発表 - GIGAZINE

安いClaudeモデルと高いClaudeモデルを組み合わせて「安価かつ高性能なAI」として動作させる仕組みをAnthropicが公開 - GIGAZINE

AIシステムはどのように失敗するのかをAnthropicが解説 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1p_kr

You can read the machine translated English article Can humans keep track of ever-so-intelli….