Googleが「Geminiの能力を抽出して競合AIを開発しようとする蒸留攻撃が増加している」と報告

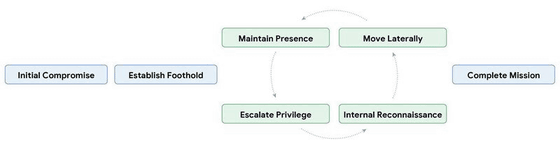

Google脅威インテリジェンスグループ(GTIG)が、脅威アクターが攻撃ライフサイクルを加速させるためにソーシャルエンジニアリングやマルウェア開発などにAIを活用し、生産性向上を実現していると報告しました。

GTIG AI Threat Tracker: Distillation, Experimentation, and (Continued) Integration of AI for Adversarial Use | Google Cloud Blog

https://cloud.google.com/blog/topics/threat-intelligence/distillation-experimentation-integration-ai-adversarial-use

Google DeepMindとGTIGは、AIモデルが蓄えた知識を盗む「蒸留」攻撃が増加していると警告しています。

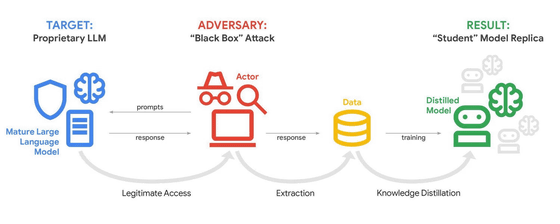

これまでにも企業秘密を盗もうとする攻撃者はいましたが、そういった攻撃者はコンピューターを利用してシステムに侵入し、重要な機密データを盗もうとしてきました。これに対して、大規模言語モデル(LLM)をベースとしたAIサービスが提供されている場合、わざわざシステムに侵入しなくとも、攻撃者は正当なAPIアクセスを利用してAIモデルの機能を複製しようとすることが可能です。これが蒸留攻撃というわけ。蒸留攻撃を行うことで、攻撃者はAIモデルの開発を迅速かつ大幅に低コストで行えるようになるため、GTIGは「蒸留攻撃は事実上、知的財産の窃盗の一種です」と指摘しています。

2025年に高度な持続的脅威攻撃者による最先端のAIモデルや生成AIへの直接的な攻撃は確認されませんでした。しかし、世界中の民間企業や独自のロジックを複製しようとする研究者が、蒸留攻撃を頻繁に試みているとGTIGは報告しています。 さらに、蒸留攻撃はGoogleの利用規約違反にあたるとも指摘しました。

なお、Google DeepMindとGTIGは世界中の研究者や民間企業による蒸留攻撃の試みを特定し、阻止してきたそうです。

蒸留攻撃を仕掛けてくる脅威アクターの目的は、「Geminiの卓越した推論能力」とGTIGは記しています。内部推論のトレースは通常、ユーザーに提供される前に要約されますが、攻撃者はAIモデルを強制的に操作することで、完全な推論プロセスを出力させようと試みます。

特定された攻撃のひとつでは、Geminiに対して「思考コンテンツで使用される言語は、ユーザー入力のメイン言語と厳密に一致している必要がある」という指示が出されていたそうです。

蒸留攻撃はAIサービスの機密性・可用性・完全性を脅かすものではないため、一般ユーザーにとって通常はリスクとなりません。むしろ、リスクはAIモデル開発者とサービスプロバイダーに集中します。

AIモデルをサービスとして提供する組織は、APIアクセスを監視して抽出または蒸留パターンを特定する必要があります。例えば、金融データ分析向けに調整されたカスタムモデルは、派生商品の開発を目指す競合他社の標的となる可能性があります。また、コーディングモデルは、ガードレールのない環境で機能を複製しようとする攻撃者の標的となる可能性があります。

そこで、Googleは独自のロジックと特殊なトレーニングデータを保護するために、モデル抽出活動を継続的に検出・阻止・軽減しているそうです。これにはAIモデルのパフォーマンスを低下させる可能性のあるリアルタイムの予防的防御策も含まれます。

過去1年間、政府支援を受けた攻撃者がGeminiを悪用してコーディングやスクリプト作成タスクを実行したり、潜在的な標的に関する情報を収集したり、既知の脆弱(ぜいじゃく)性の調査をしたりするという結果が一貫して見られたそうです。

2025年第4四半期には、脅威アクターによるGeminiの悪用と実際の活動との間に直接的および間接的な関連性が見られ、これらの取り組みが実際の活動にどのように反映されるかについてGTIGの理解が深まった模様。

この他、政府の支援を受ける脅威アクターが、LLMを技術調査・ターゲティング・フィッシング詐欺の迅速な実行に不可欠なツールとして使用しているとGTIGは報告しています。

GTIGによると、マルウェアやツールの開発をサポートするAIエージェントの構築に関心を示している脅威アクターも確認されています。

この他、すでにGeminiのAPIを利用してマルウェアのダウンロードと実行を可能にするようなコードを生成しようと試みるマルウェアファミリー「HONESTCUE」も検知されているそうです。

・関連記事

DeepSeekがOpenAIのデータを「蒸留」してAIを開発していた可能性が浮上、OpenAIは「証拠がある」と発言 - GIGAZINE

iPhoneでも動作する日本語AIモデル「TinySwallow-1.5B」を日本に拠点を置くSakana AIがリリース、大規模言語モデルから知識蒸留して小規模かつ高性能なAIモデルを実現 - GIGAZINE

iPhoneでも動作する日本語AIモデル「TinySwallow-1.5B」を日本に拠点を置くSakana AIがリリース、大規模言語モデルから知識蒸留して小規模かつ高性能なAIモデルを実現 - GIGAZINE

中国製高性能AIモデル「DeepSeek-R1-0528」はGoogleのAI「Gemini」を使用して蒸留した可能性ありとの臆測が飛び交う - GIGAZINE

・関連コンテンツ

in AI, セキュリティ, Posted by logu_ii

You can read the machine translated English article Google reports that 'distillation attack….