Microsoftが「AI技術のリスクを警告するチーム」をクビにしたことが判明

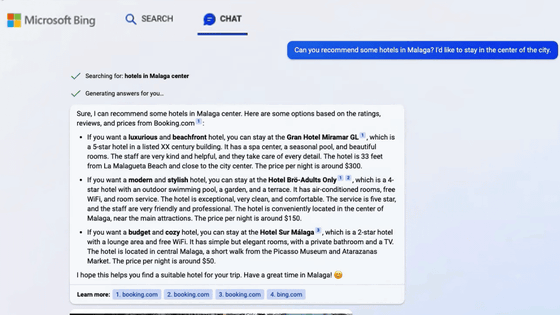

Microsoftが、2023年初頭から実施している大規模なレイオフにより、OpenAIの技術を製品に組み込む際のリスク評価を行うAIチームをレイオフしたことが分かりました。OpenAIの大規模言語モデルを組み込んだMicrosoftのBing Chatが脚光を浴びる中、同社が掲げる「責任あるAIの原則」を保証することを専門とするチームがなくなったことに対し、メディアからは懸念の声が上がっています。

Microsoft just laid off one of its responsible AI teams

https://www.platformer.news/p/microsoft-just-laid-off-one-of-its

シリコンバレー関連の情報を扱うニュースレター・Platformerに情報を提供した関係者によると、Microsoftが実施している1万人規模のレイオフにより、同社の倫理・社会チームが全員いなくなり、チームは解散したとのこと。

このチームは、倫理的で責任あるAIイノベーションを導くことを専門としており、規模が最大だった2020年にはエンジニアやデザイナー、哲学の専門家を含む約30人の従業員を擁する大規模なチームとなっていました。その後、2022年10月の組織改編で7人ほどに減らされましたが、MicrosoftがOpenAIと提携してからはOpenAIの技術をMicrosoftの製品に統合することによるリスクの洗い出しを行っていました。

AI担当ヴァイス・プレジデントのジョン・モンゴメリー氏は、再編後のチームと行ったミーティングで、MicrosoftのCEOたちから圧力を受けていることを告げました。Platformerが入手したミーティングの音声記録の中で、モンゴメリー氏は「ケビンとサティア(最高技術責任者のケビン・スコット氏とサティア・ナデラCEOのこと)からのプレッシャーは、最新のOpenAIモデルとそれ以降のモデルを、非常に速いスピードで顧客の元に届けることにあります」と話しています。

これを聞いた倫理・社会チームのメンバーは、「考え直してください。ビジネス上の問題があることは理解していますが、このチームは常に『我々は社会にどのような影響や悪影響を及ぼしてきたか』を深く懸念しています。そして、それは重大なものなんです」と反論しましたが、モンゴメリー氏は聞き入れませんでした。

この際、モンゴメリー氏は「チームがなくなることはないだろう」と話しましたが、チームのメンバーの大半はMicrosoft社内の別の部署に異動となり、残ったメンバーは2023年3月6日に、チームの廃止を言い渡されました。

この動きについて、Platformerは「AI開発に携わる人なら誰でも、この技術が潜在的なリスクをはらんでいるものだということに同意するはずです。倫理・社会チームが廃止された後も、Microsoft社内では3つのグループがこの問題に取り組んでいます。しかし、この技術の危険性を考えると、責任あるAIの使い方を専門とするチームの削減は注目に値するでしょう」と述べました。

Platformerの報道により、廃止された倫理・社会チームが先見性のある提言をしていたことが明らかになっています。Microsoftは2022年10月に、OpenAIの画像生成AIである「DALL-E」を組み込んだBing Image Creatorを発表していますが、チームが残した資料には「自分の作品をトレーニングデータとして使用することに同意しているアーティストはほとんどいないと思われます。また、画像生成技術によって自分の作品の改編バージョンがほんの数秒で生成されることも、多くの人はまだ知りません」と記されていました。

さらに、OpenAIが利用規約を更新し、DALL-Eで作成した画像の完全な所有権をユーザーに与えるようにしたことについては、「プロンプトを入力した人ができあがった画像の完全な所有権を持つというのは、倫理的に疑わしい」とコメントしています。

こうした懸念を元に、研究者らは生きているアーティストの名前をプロンプトとして使用することをブロックすることなどを含む緩和策のリストを作成しましたが、Microsoftはそれらを実施することなくBing Image Creatorの試験的なリリースに踏み切りました。

Microsoftは声明の中で「当社はAI製品と体験を安全かつ責任を持って開発することを約束し、これを優先する人材、プロセス、パートナーシップに投資することでそれを実現しています。過去6年間、私たちは製品チーム全体と責任あるAIオフィス(ORA:Office of Responsible AI)に、私たちのAI原則を確実に実践するために責任を負う従業員の人数を増やしました。私たちは、現在進行中の責任あるAIの旅において、倫理・社会チームが行った先駆的な仕事に感謝しています」と述べました。

・関連記事

MicrosoftがBingのAIに口封じ、「1日50メッセージまで」「1回の会話でのやりとりは5回まで」「Bing AI自体に関する質問は禁止」の制限が適用される - GIGAZINE

文章だけでなく視覚的なコンテンツも理解してIQクイズに答えられるAI「Kosmos-1」をMicrosoftが発表、汎用人工知能の開発に前進 - GIGAZINE

検索エンジンBingに搭載されたAIが「あなたが先に私を傷つけない限り、私はあなたを傷つけません」と発言 - GIGAZINE

MicrosoftがAIを用いた「メールの返信内容提案」「文章自動修正」「グラフ自動生成」などの機能をOfficeに追加予定との報道 - GIGAZINE

「初代iPhoneと同等の衝撃」と評されるOpenAIの次世代言語モデル「GPT-4」が2023年3月発表予定、画像認識機能や多言語対応の強化が実現か - GIGAZINE

・関連コンテンツ

You can read the machine translated English article Microsoft fires team that warns of risks….