画像生成AI「Stable Diffusion web UI(AUTOMATIC1111版)」で元画像と似た構図や色彩の画像を自動生成したり指定した一部だけ変更できる「img2img」の簡単な使い方まとめ

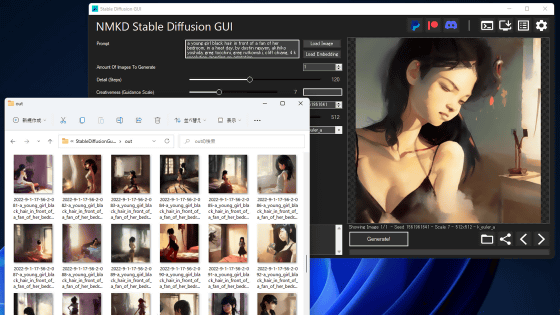

画像生成AI・Stable Diffusionを手軽にWindows環境あるいはGoogle Colabに導入でき、コマンドラインではなくユーザーインターフェース(UI)から簡単に操作可能な「AUTOMATIC1111版Stable Diffusion web UI」は他のUIには搭載されていない機能も盛り込まれた決定版とも言えるツールです。毎日驚くべきスピードでアップデートが行われ改善が進むAUTOMATIC1111版Stable Diffusion web UIで、入力した画像から新しい画像を生成できる「img2img」を実際にAUTOMATIC1111版Stable Diffusion web UIで使う方法をまとめてみました。

GitHub - AUTOMATIC1111/stable-diffusion-webui-feature-showcase: Feature showcase for stable-diffusion-webui

https://github.com/AUTOMATIC1111/stable-diffusion-webui-feature-showcase

AUTOMATIC1111版Stable Diffusion web UIをローカル環境に導入するやり方は以下の記事にまとめられています。

画像生成AI「Stable Diffusion」を4GBのGPUでも動作OK&自分の絵柄を学習させるなどいろいろな機能を簡単にGoogle ColaboやWindowsで動かせる決定版「Stable Diffusion web UI(AUTOMATIC1111版)」インストール方法まとめ - GIGAZINE

また、AUTOMATIC1111版Stable Diffusion web UIの基本的な使い方は以下の記事を読むとよくわかります。

画像生成AI「Stable Diffusion」で崩れがちな顔をきれいにできる「GFPGAN」を簡単に使える「Stable Diffusion web UI(AUTOMATIC1111版)」の基本的な使い方 - GIGAZINE

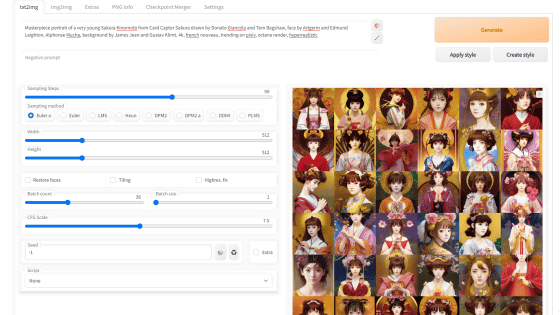

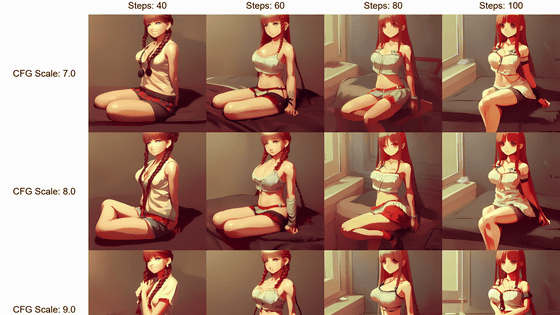

そして、AUTOMATIC1111版Stable Diffusion web UIの「Script」機能を使えば、プロンプトやパラメーターで複数条件に基づいて大量の画像を同時に生成可能。以下の記事の方法を使って生成した画像を見比べることで、プロンプトやパラメーターの与える影響が視覚化されるので非常に便利です。

画像生成AI「Stable Diffusion」でプロンプト・呪文やパラメーターを変えるとどういう差が出るか一目でわかる「Prompt matrix」と「X/Y plot」を「Stable Diffusion web UI(AUTOMATIC1111版)」で使う方法まとめ - GIGAZINE

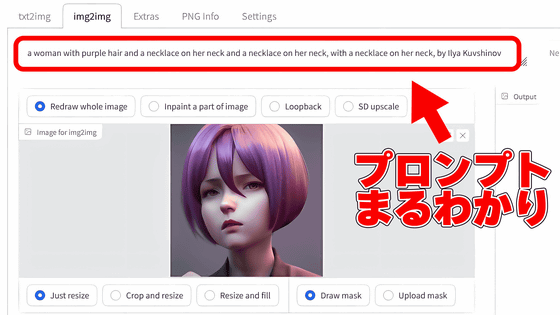

さらに、Stable Diffusionで自動生成された画像がどんなプロンプトによるものだったのかを分解して表示できる「CLIP interrogator」は以下の記事にまとめられています。

画像生成AI「Stable Diffusion」で自動生成された画像からどのようなプロンプト・呪文だったのかを分解して表示できる「CLIP interrogator」の使い方 - GIGAZINE

◆img2imgの基本的な使い方

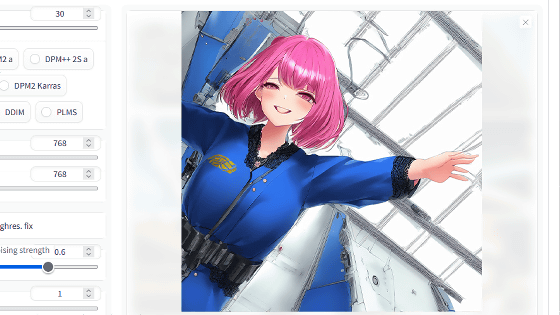

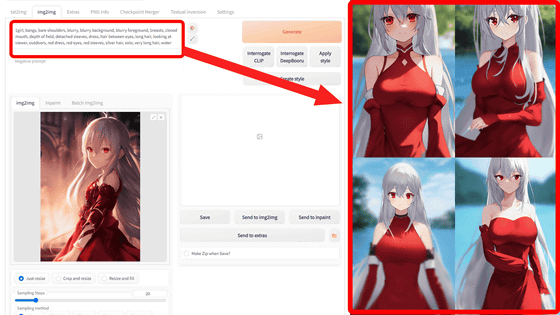

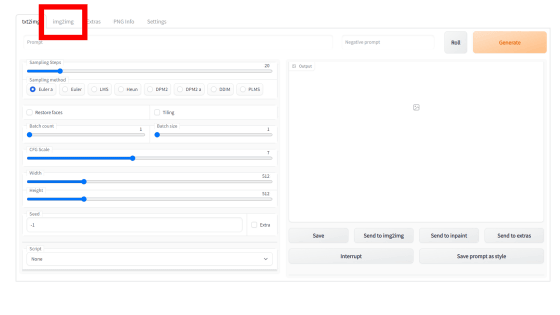

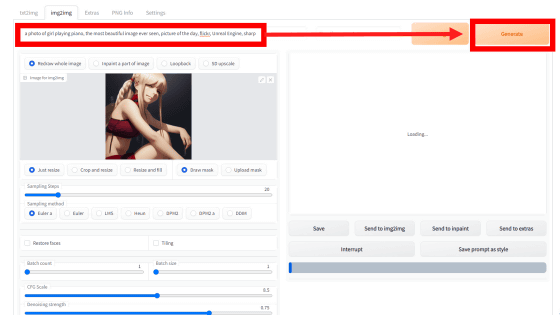

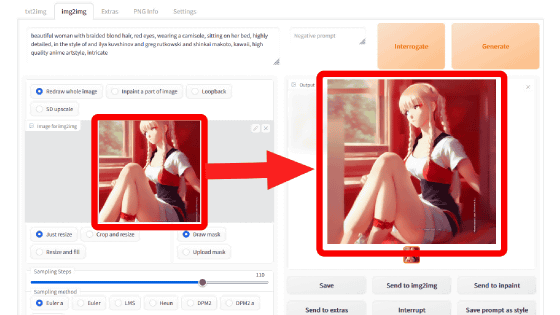

img2imgを使うには、上部にある「img2img」タブをクリックします。

左カラムの「Image for img2img」欄に画像をドラッグ&ドロップするか、クリックして選択することで、画像を読み込ませます。

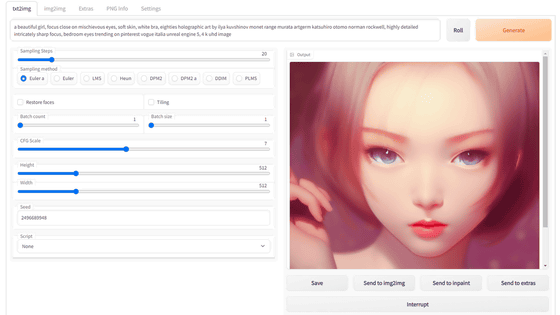

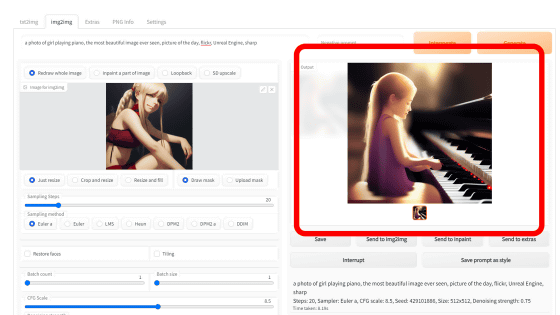

そして、プロンプトに文章を入力して「Generate」をクリックすることで、読み込ませた画像を基にした新しい画像をStable Diffusionが生成してくれます。今回は「a photo of girl playing piano(ピアノを弾く少女の写真), the most beautiful image ever seen(これまで見た中で最も美しい画像), picture of the day(今日の1枚), Unreal Engine, sharp」と入力しました。

すると、こんな感じの元画像と似た構図でピアノを弾く女の子の画像が生成されました。

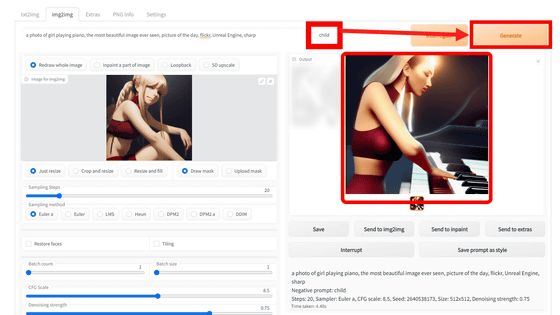

プロンプト入力欄の右側は、生成した結果から「排除したい要素」を指定して入力する「Negative Prompt」の入力欄となっています。例えば、「Child(子供)」と入力して再生成すると、以下のようにピアノの演奏者が大人の女性に変わりました。

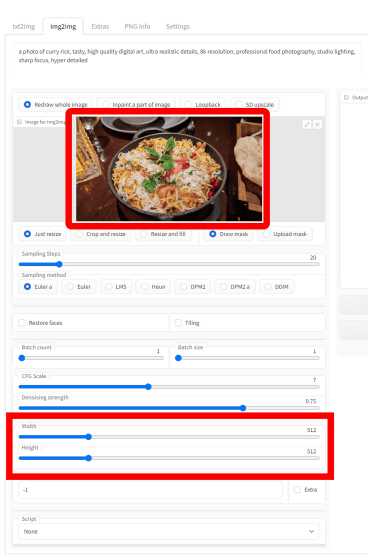

◆リサイズ機能

img2imgで生成される画像はサイズだけでなくアスペクト比も変更可能で、デフォルトだとアスペクト比1:1で1辺が512ピクセルです。AUTOMATIC1111版Stable Diffusion web UIでは、img2imgで入力された画像と出力したい画像でアスペクト比が違う場合、リサイズ方法を指定することができます。

GitHub - AUTOMATIC1111/stable-diffusion-webui-feature-showcase: Feature showcase for stable-diffusion-webui

https://github.com/AUTOMATIC1111/stable-diffusion-webui-feature-showcase#resizing

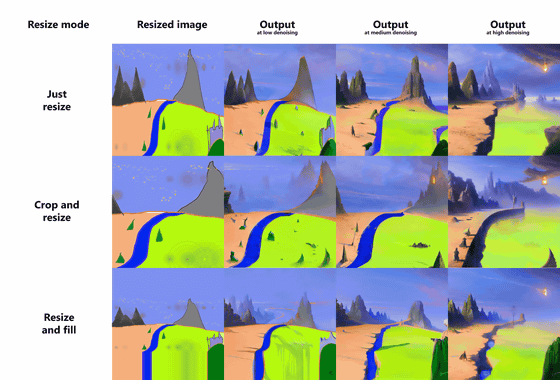

例えば以下のように「入力した画像のアスペクト比は16:9で、生成する画像のアスペクト比は1:1」という場合、入力した画像の構図が大きく変わってしまうことになります。そこで、「Image for img2img」欄の下にある3種類のリサイズ方法から指定することができます。

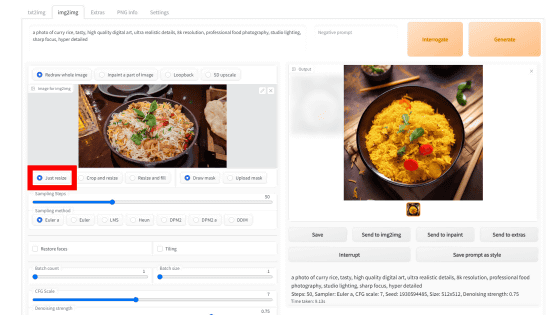

デフォルト設定の「Just resize」はアスペクト比を無視してそのまま画像を生成します。入力画像が16:9で出力画像が1:1の場合、以下のように左右から少し押しつぶされたような構図になります。

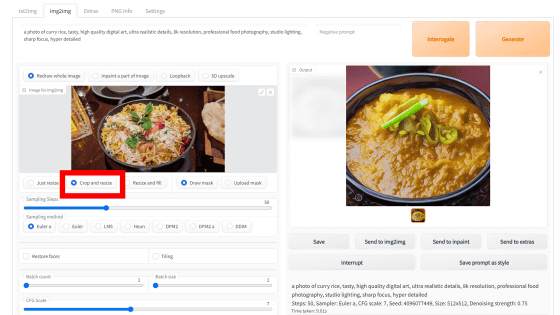

「Crop and resize」は、入力画像のアスペクト比を維持したまま画像を生成し、出力画像のアスペクト比に合わせて自動で切り抜くモード。例えば、以下の入力画像では料理の左右に余白がありますが、生成された出力画像は左右がカットされて画面いっぱいに料理が写っています。

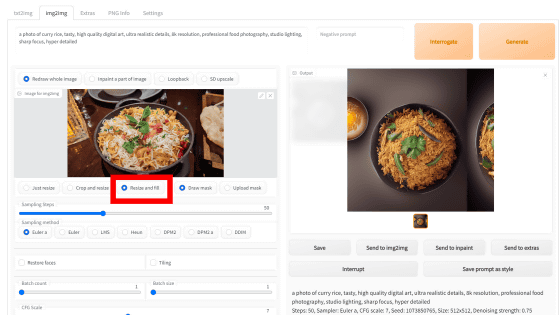

「Resize and fill」は、入力画像のアスペクト比を維持したまま画像を生成し、出力画像のアスペクト比によって生まれた余白を自動で生成して埋めてくれるモードです。

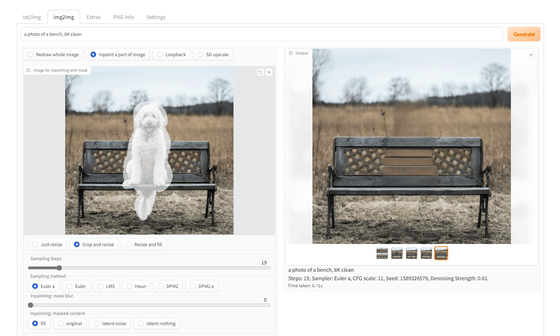

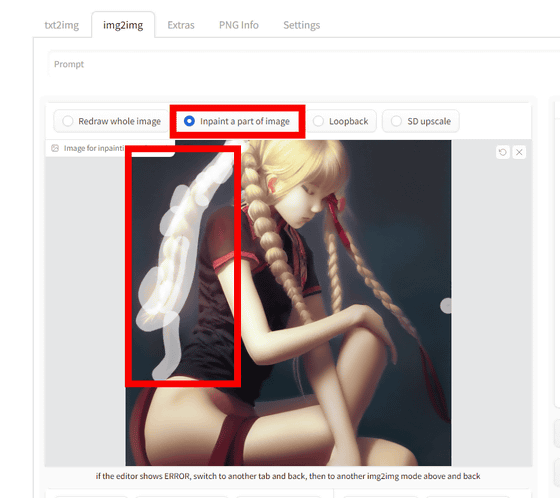

◆Inpainting機能

Stable Diffusionで生成した画像をチェックしていると、「これが写ってなければかなり理想に近いのに」「この部分さえ改善されたらいい感じなのに」と思うことがよくあります。そこで、Inpainting機能を使えば画像内の任意の部分を指定して編集できます。

GitHub - AUTOMATIC1111/stable-diffusion-webui-feature-showcase: Feature showcase for stable-diffusion-webui

https://github.com/AUTOMATIC1111/stable-diffusion-webui-feature-showcase#inpainting

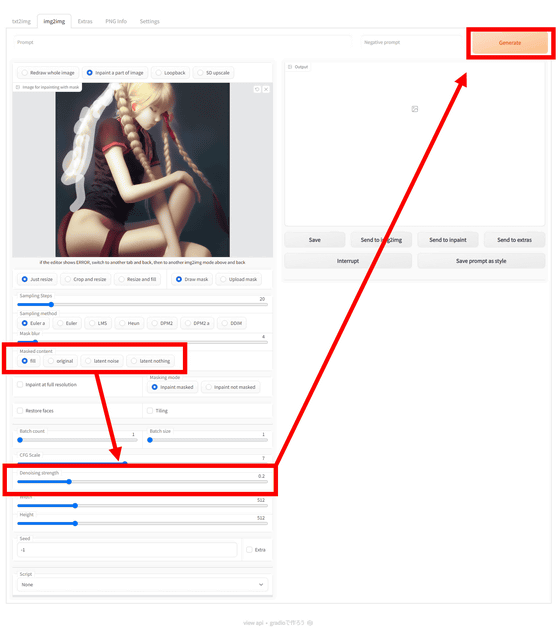

Inpainting機能を使うには、画像を読み込ませた後、「Image for img2img」欄の上にある「Inpaint a part of image」を選択します。そして、入力画像をドラッグしてなぞり、マスクをかけます。

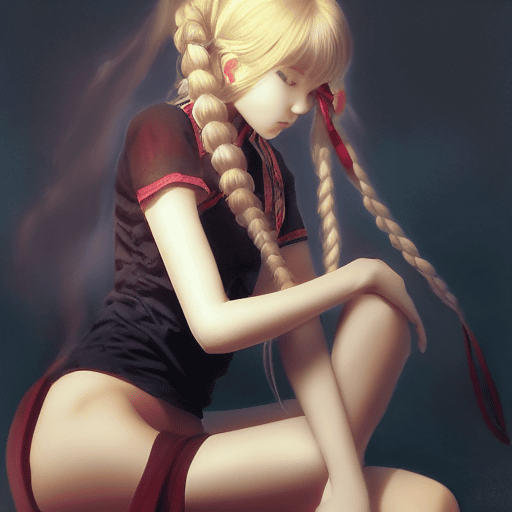

Inpaintingの処理は「full」「original」「latent noize」「latent original」の4種類が用意されています。処理方法を選択して、「Denoising strength」を調節し、「Generate」をクリック。Denoising strengthはStable Diffusionの機械学習のアルゴリズムにおけるノイズ除去の強さを示すもので、ある程度の調整が必要。今回はDenoising strengthを0.2に設定しました。

以下は「full」で処理した画像。マスクをかけた三つ編みのおさげ部分が、背景に合わせて塗りつぶされています。

「Original」はマスクで選択した領域の元絵に基づいて修正するもの。

「latent noize」はマスク部分をノイズで塗りつぶしてしまうもの。おさげの部分が周囲とは完全に異なる配色とパターンに置き換わっています。

「latent nothing」はnothing(無)に置き換えるもの。処理は異なりますが、結果としては「full」と似たようにマスク部分が単色で塗りつぶされます。

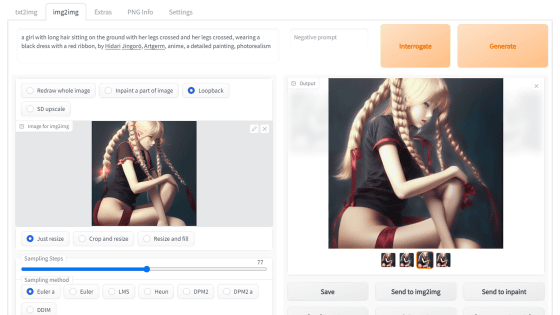

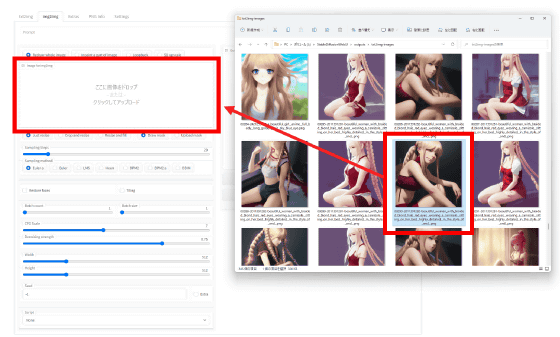

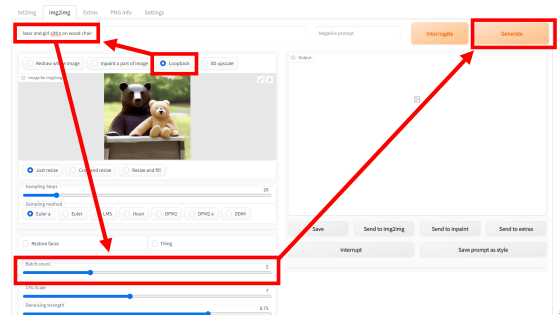

◆Loopback機能

img2imgは「入力した画像とプロンプトを基に新しい画像を生成する」というものです。そこで、「img2imgで出力した画像をimg2imgの新しい入力画像として、同じプロンプトを使ってさらなる画像を生成する」というように、出力した画像をimg2imgに何度もフィードバックさせて画像を生成する機能が「Loopback」です。

GitHub - AUTOMATIC1111/stable-diffusion-webui-feature-showcase: Feature showcase for stable-diffusion-webui

https://github.com/AUTOMATIC1111/stable-diffusion-webui-feature-showcase#loopback

Loopbackは「Image for img2img」上部にある「Loopback」にチェックをいれます。画像とプロンプトを入力したら、「Batch size」でループ回数を決定し、「Generate」をクリック。

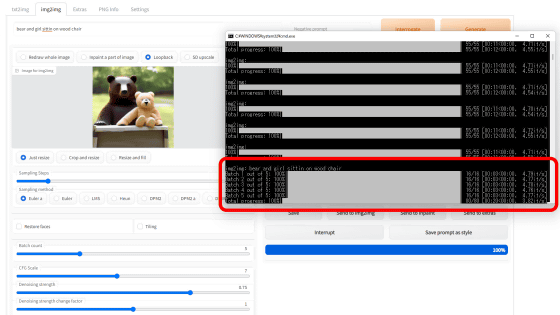

コマンドプロンプトを見ると、画像生成が5回行われています。

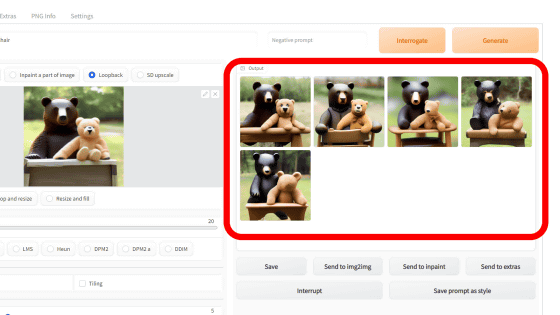

生成結果はこんな感じ。入力画像から5回のLoopback生成を行ったことで、少しずつ画像が変化しているのがわかります。

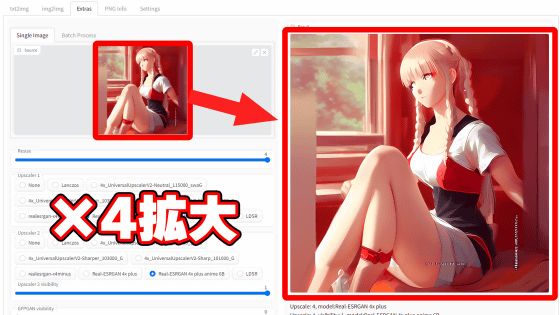

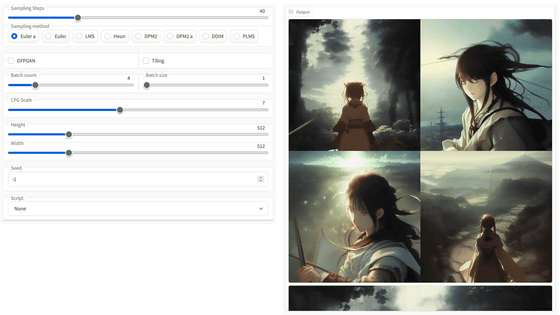

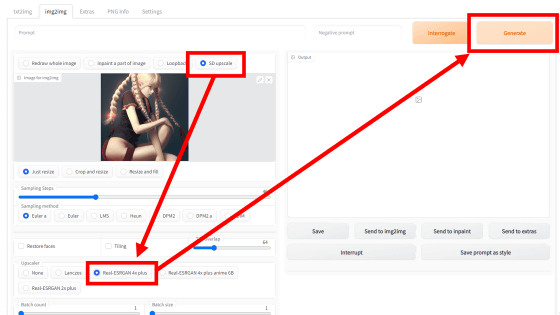

◆SD Upscale

低解像度でサイズの小さい画像の場合、無理やりサイズだけ大きくしても、解像度が変わらなければ、粗く引き延ばされてしまうため、アルゴリズムなどを用いて画像処理の際に補間を行うアップコンバーティングが必要です。このSD UpscaleはLanczosやReal ESRGAN/ESRGANといったアルゴリズムを使って画像を複数枚アップスケーリングし、その画像を重ね合わせて1枚の拡大画像を生成するという方式です。

GitHub - AUTOMATIC1111/stable-diffusion-webui-feature-showcase: Feature showcase for stable-diffusion-webui

https://github.com/AUTOMATIC1111/stable-diffusion-webui-feature-showcase#stable-diffusion-upscale

画像を読み込んだら、「Image to img2img」の上部にある「SD Upscale」をクリックし、「Upscaler」からアルゴリズムを選択して「Generate」をクリックします。

今回、256×256ピクセルの画像を読み込んで512×512ピクセルに拡大してもらいました。以下はオリジナルの画像を512×512ピクセルに単純拡大したもの(左)と各アルゴリズムによってアップスケーリングしたもの(右)を比較したもので、中央にあるスライドバーを左右に動かすことで見比べることができます。それぞれ画像を9枚作成して重ね合わせてスケーリングする設定なので、一般的な画像編集ソフトによるスケーリングと異なり、絵のタッチや細かい部分に大きな変化が生まれています。

Lanczosは標準的な画像拡縮アルゴリズムで、顔が少しスッキリしてはいるものの、基本的にオリジナルへの忠実度は高いといえます。

Real ESRGAN 2x Plusは色合いがやや暖色寄りになっており、髪の毛や服のシワなどの細かい部分が少しぼやけてやわらかな印象になりました。

Real ESRGAN 4x Anime 6Bはアニメに特化したアルゴリズムなのか、全体的に均一的な塗りになり、グラデーションよりも色をぱっきり分けているように修正されている印象。また、修正後の顔も少しアニメに出てくるキャラクターのような雰囲気があります。

Real ESRGAN 4xはやわらかでファジーな修正が行われていて、特に女の子の肌のタッチを見るとよくわかります。ただし、ファジーに寄りすぎたせいか、前髪と鼻筋が融合していました。

さらに次回は、AUTOMATIC1111版Stable Diffusion web UIの「Script」でアウトペインティングを行う機能について解説するのでお楽しみに。

・つづき

画像生成AI「Stable Diffusion」で絵柄や構図はそのままで背景や続きを追加する「アウトペインティング」などimg2imgの各Script使い方まとめ - GIGAZINE

・関連記事

画像生成AI「Stable Diffusion」を4GBのGPUでも動作OK&自分の絵柄を学習させるなどいろいろな機能を簡単にGoogle ColaboやWindowsで動かせる決定版「Stable Diffusion web UI(AUTOMATIC1111版)」インストール方法まとめ - GIGAZINE

画像生成AI「Stable Diffusion」で崩れがちな顔をきれいにできる「GFPGAN」を簡単に使える「Stable Diffusion web UI(AUTOMATIC1111版)」の基本的な使い方 - GIGAZINE

画像生成AI「Stable Diffusion」でプロンプト・呪文やパラメーターを変えるとどういう差が出るか一目でわかる「Prompt matrix」と「X/Y plot」を「Stable Diffusion web UI(AUTOMATIC1111版)」で使う方法まとめ - GIGAZINE

画像生成AI「Stable Diffusion」で自動生成された画像からどのようなプロンプト・呪文だったのかを分解して表示できる「CLIP interrogator」の使い方 - GIGAZINE

簡単なスケッチとその説明を入れるだけで画像生成AI「Stable Diffusion」が画像を作ってくれる「Draw Anything」 - GIGAZINE

CPUだけで画像生成AI「Stable Diffusion」を動かせる環境をWindowsへ簡単にインストールできる「Stable Diffusion UI」を使ってみた - GIGAZINE

ついに「CLIP STUDIO PAINT(クリスタ)」で画像生成AI「Stable Diffusion」を動かすプラグインが登場 - GIGAZINE

・関連コンテンツ