Anthropicがプルリクエストのバグを自動検出する「Code Review」を発表、1回あたりのトークン使用量は平均2400円分から

Anthropicが、人間のレビュー担当者でも見逃しがちなバグも検出できるとする高度なマルチエージェントレビューシステム「Cpde Review」を発表しました。

Code Review for Claude Code | Claude

https://claude.com/blog/code-review

Introducing Code Review, a new feature for Claude Code.

— Claude (@claudeai) March 9, 2026

When a PR opens, Claude dispatches a team of agents to hunt for bugs. pic.twitter.com/AL2J4efxPw

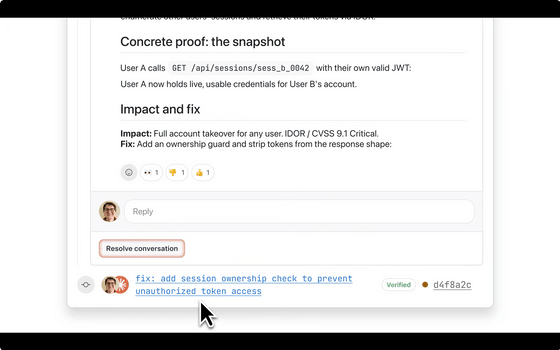

Code Reviewは、作成されたプルリクエストに対してAIエージェントのチームを派遣し、表面的な確認では見逃されがちなバグを発見するシステムです。エージェントはバグを探し、誤検出を減らすために検証を行い、重要度に基づいてバグをランク付けします。その結果はプルリクエスト上に1つの概要コメントとして投稿され、さらに具体的なバグについてはインラインコメントが追加されます。実際にプルリクエストを承認するかどうかはユーザーの手に委ねられます。

レビューの規模はPRの内容に応じて変わります。大きい変更や複雑な変更にはより多くのエージェントが割り当てられ、より深いレビューが行われます。一方、軽微な変更には軽量なレビューが実施されます。

Anthropicは発表の数カ月前から社内でCode Reviewを運用していて、変更行数が1000行以上の大規模プルリクエストでは84%で問題を検出し、平均7.5件の問題を発見していたとのこと。一方、50行未満と小規模なプルリクエストでは、検出率は31%、平均0.5件でした。エンジニアの多くは検出内容に同意しており、誤りとの指摘は1%未満だったそうです。テストでは、平均的なレビュー時間は約20分でした。

Anthropicによれば、同社のエンジニア1人あたりのコード出力量が過去1年で200%増加した結果、コードレビューがボトルネックになっていて、同様の話を顧客からも聞いていたとのこと。これにより「すべてのプルリクエストを安心して任せられるレビュアー」が必要とされ、その結果生まれたのがCode Reviewだそうです。

AnthropicはCode Reviewを「スピードではなく深さを重視した設計」と紹介しています。徹底的にレビューする分コストが高くなっていて、一般的には1回当たり15ドル(約2400円)~25ドル(3900円)分のトークンを消費するとのこと。

その高さに目を付けたOpenAIの従業員は「レビュー1件当たり25ドルも払いたくない場合はOpenAIの製品を使ってください」とアピールしています。

If you want AI Code Review, but don't want to pay $25 per review (not a typo), check out Codex Review!

— Rohan Varma (@rohanvarma) March 9, 2026

It leverages frontier Codex models, finds complex issues, and 100% usage based. Most runs should cost ~$1 or lesshttps://t.co/43iF6rq8Xa

Code ReviewはTeamおよびEnterpriseプラン向けにベータ版のリサーチプレビューとして利用できます。

・関連記事

OpenAIが脆弱性の発見・検証・修正を自動化するAIエージェント「Codex Security」を発表 - GIGAZINE

AnthropicとMozillaが連携、Claude Opus 4.6がFirefoxで100件超のバグをわずか2週間で発見しそのうち14件は高深刻度 - GIGAZINE

GoogleによるAIを用いた大量バグ報告にFFmpegが「ボランティアに仕事を押し付けている」「検出&報告の実績を作りたいだけ」と苦言 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1p_kr

You can read the machine translated English article Anthropic announces 'Code Review' to aut….