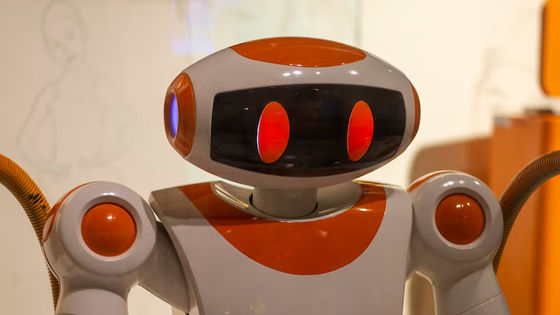

唇の動きが異様にリアルなヒューマノイドロボットが誕生

ヒューマノイドロボットの口の動きを自然に見せるには、音声に合わせて唇やあごを細かく動かす必要があります。しかし、人間の口形をひとつひとつルールとして作り込む方法は手間が大きく、別のロボットや別の言語に広げにくいという課題があります。コロンビア大学の研究チームは音声に合わせて口形を作れるロボットの顔面機構を開発し、ロボットが自分の顔を動かして得た映像と音声から推定した「理想の口形」を突き合わせて学習させ、音声から口の動きを推定するという手法を提案しました。

(PDFファイル)Learning realistic lip motions for humanoid face robots

https://generalroboticslab.com/assets/files/papers/lip.pdf

A Robot Learns to Lip Sync | Columbia Engineering

https://www.engineering.columbia.edu/about/news/robot-learns-lip-sync

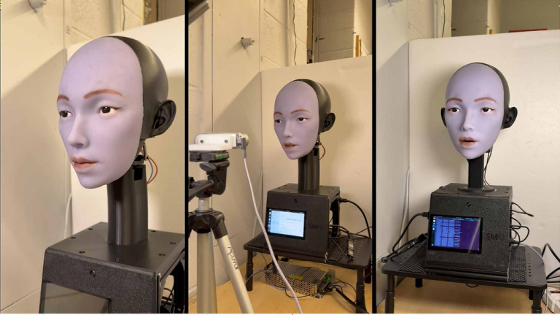

コロンビア大学のCreative Machines Labに所属するユーハン・フー氏やホッド・リプソン氏らの研究チームが開発したロボットの顔は柔らかいシリコン製の唇を備えており、口角・上唇・下唇・あごを合わせて10カ所を別々に動かせる仕組みになっています。唇の皮膚を「引っ張る」だけでなく「押す」動きもできる構造を採用し、口をすぼめる動作や唇をきっちり閉じる動作といった発話に必要な形を作れるようにしました。

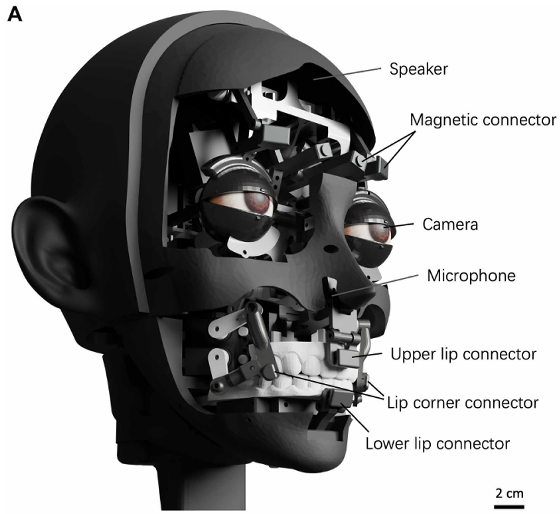

顔の内部にはカメラやマイク、スピーカーなどが組み込まれており、口角や上唇・下唇を動かすためのコネクターも配置されています。

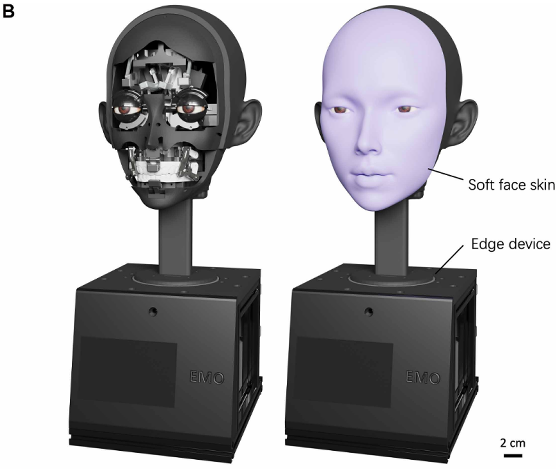

顔の外装を外した状態と外装を被せた状態を並べた図が以下。外装の下に、制御用のデバイスが組み込まれていることが示されています。

研究チームは、音声に合わせてロボットの唇が動く様子をデモ動画で公開しています。以下の動画では複数の言語の音声に合わせて口の動きを同期させる様子を見ることができ、どれだけリアルに唇が動くのかが一発で分かります。

A Robot Learns to Lip Sync - YouTube

音声と口の動きが合っていないと、見た目の不自然さが強まり不気味だと感じられやすくなる可能性がありますが、フー氏は「不気味の谷を越えつつある」と述べ、人型ロボットの顔が今後自然に動くようになるという見通しを示しています。

学習は、人間が発話する際の口形を正解として大量に用意する形ではなく、ロボット自身の動きから始まりました。まずロボットがランダムに唇を動かすモーターバブリングを行い、カメラで撮影したロボットの唇の映像と、そのときのモーター指令を対にしたデータを集めます。次に、音声から口の動きを合成するWav2Lipを使い「この音声なら口はこう動くはず」という参照映像を作りました。

そのうえで研究チームは、参照した映像と実機の映像の差を埋めるために、画像の特徴を圧縮して扱う変分オートエンコーダーを用いました。参照した映像の「口形の特徴」に近づくようにモーター指令を学習させることで、映像から動作へ変換します。さらに、動きがカクつかないように、過去のモーター指令の流れも見ながら次の指令を予測する「facial action transformer(FAT)」を組み合わせ、時間方向のつながりをなめらかにしました。

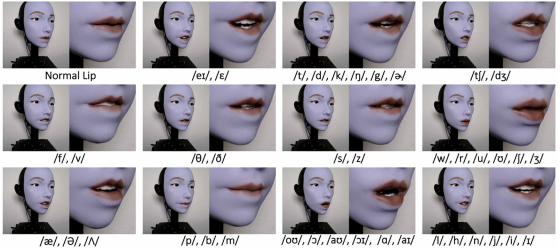

学習で得られた口形の例を発音(音素)ごとに並べた図が以下です。

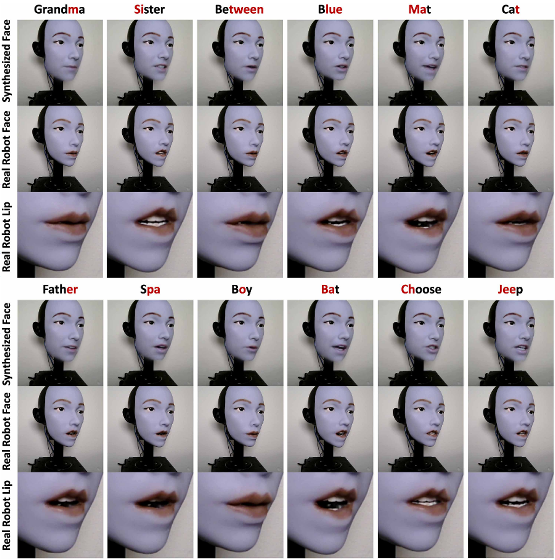

単語と対応する口の動きはこんな感じ。

研究チームが今回提案した「ロボットが自分の顔を動かして得た映像と、音声から推定した理想の口形を突き合わせて学習させ、音声から口の動きを推定する」という手法の精度を「口周りの特徴量から近いフレームを選ぶ手法」「音声の振幅に合わせてあごだけを上下させる手法」「音声と口形に意図的な時間のずれを入れる手法」「ランダムに動かす手法」などの比較対象と比べた結果、今回提案された手法が最も高精度であることが確かめられました。

また、研究チームは唇の動きの見た目が自然かどうかを確かめるために、提案した手法と既存の2種類の手法を比べるアンケート調査を実施しました。その結果、研究チームは「提案した手法が選ばれる割合が62.5%だった」と報告しています。

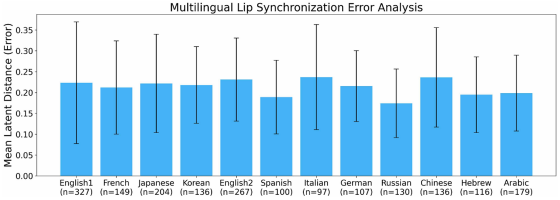

研究チームは多言語への一般化も検証しています。英語に加えてフランス語・日本語・韓国語・スペイン語・イタリア語・ドイツ語・ロシア語・中国語・ヘブライ語・アラビア語の合計11言語で評価したところ、英語以外の言語でも英語(女性音声)で出た誤差の範囲内に収まることが多く、少なくとも極端な悪化は目立たなかったと報告しました。

一方で、唇の動きがどの発音でも同じように得意になったわけではなく、唇を強く閉じる必要がある子音の「B」や、唇をすぼめる「W」のような発音では課題が残っています。リプソン氏は「人間とやり取りするほど精度が上がる」と述べ、実運用の中で改良が進む可能性に言及しました。

顔が自然に動くほど、人は「ロボットにも人間のような感情や意図がある」と受け取りやすくなります。リプソン氏はこの点を踏まえ「利益を得つつリスクを抑えるためにはゆっくり慎重に進める必要がある」と述べています。

・関連記事

Googleがムービーの自動吹替&リップシンクAIを開発中、声色を変えずに吹替可能で高性能すぎて悪用注意とのこと - GIGAZINE

Microsoftが顔写真と音声ファイルからリアルに話す映像を作成できるAIモデル「VASA-1」公開 - GIGAZINE

Googleが動画生成AI「Veo 3」を発表、4K出力可能で音声も同時に生成できる - GIGAZINE

不気味の谷を乗り越えても今度は「大量生産されたヒューマノイドの顔」が人間に不快感をもたらす可能性 - GIGAZINE

・関連コンテンツ

in 動画, ハードウェア, サイエンス, Posted by log1b_ok

You can read the machine translated English article A humanoid robot with incredibly realist….