機械学習でコンピューターが音楽を理解することが容易ではない理由

音楽は、目には見えない音を使って何かを表現するという主観的な要素を持つと同時に、楽譜という記号を使って構築することが可能な幾何学的・数学的な要素を併せ持つ芸術です。進化が著しい機械学習を使うことでコンピューターが音楽を理解することの難しさについて、作曲家とAI研究者という2つの顔を持つパトリック・ハッチンソン氏が分析しています。

Music and Machine Learning - ai.SensiLab

http://ai.sensilab.monash.edu/2018/08/23/Neural-Music/

昨今の機械学習の発展により、コンピューターは言葉や画像を認識することができるようになってきました。言葉も画像も、情報を伝えるコミュニケーションツールという点では共通の役目を持っており、それは音楽についても同じことがいえます。音楽は、文化的グループもしくは特定グループにおけるコミュニケーション上の役割を担うとハッチンソン氏は述べています。一方で、音楽はそれ自体に「意味」があるものではありません。音楽の音の一つ一つは、言葉の単語一つ一つのように特有の意味を持つものではないためです。

それにもかかわらず興味深いのは、単体では意味を持たない「音」であっても、それらが集まって「音楽」になることで、本来はなかったはずの「意味」を持つところにあります。この点についてハッチンソン氏は、次のような例を挙げながら説明しています。

・音楽的コンテンツと非音楽的コンテンツはともに、1つの音シグナルによって成り立つことができる。

・もしオフィスで、自分の携帯電話の着信かどうかを聞き分けるために音に耳を傾けているとしたら、それは「音楽」ではない。

・着信音に耳を傾ける時に、「誰からの着信か」ではなく音自体のシェイプやテクスチャの具合、リズムなどを聞いているとすれば、それは「音楽」である。

By Terry Chay

ハッチンソン氏によると、この「音楽か非音楽か」という分類が持つ意味は、文化および進化生物学の観点において興味深いことであると同時に、データサイエンティストにとっても非常に重要なものでもあるとのこと。その理由の1つ目は「言語を理解する自然言語モデルは、音楽の解析と創造(=作曲)を行う上で効果的なツールにはならない」ということを意味するものであり、自然言語と音楽とではデータの機能と構造が全く異なるものであるとハッチンソン氏は述べています。

自然言語処理の分野では、単語の持つ埋め込み情報と分散表現を学習することが可能なニューラルネットワークword2vecの出現がブレークスルーとなって進化が進みましたが、「単語」というものを持たない音楽においてはこの手法は当てはまらないとのこと。音楽において「音」とは「音色」と「音程」と「長さ」という要素を持つものではありますが、その音自体に意味が込められることはほぼありません。そのため、少なくとも既存の機械学習システムは、音楽よりも自然言語の解析の方により適しているといえるとハッチンソン氏は述べています。

By Brandon Giesbrecht

これは、言語と音楽のそれぞれが生まれ、使われてきた背景が大きく影響を及ぼしているとのこと。言語はコミュニティの中で情報を伝えて共有することを目的に発達してきたものですが、音楽は「楽しむこと」が大きな目的だったとハッチンソン氏はいいます。そのため、音楽は言語のような「構文」などの概念に縛られることがほとんどないまま進化を続けてきました。

しかし同時に、音楽には「良い音楽」とされるものと「悪い音楽」とされるものがあり、「良い音楽」には共通の「構文」のようなものが存在するという、逆説的な状況があるというのも事実です。そのいくつかは次のような概念で示されます。

・1:繰り返し

多くの人は、楽曲の中で同じフレーズなどが何度も繰り返されることを好みます。逆に、いわゆる「サビ」などの印象的なフレーズが一度も繰り返されない楽曲があるとすれば、それは聴き手にとって追随することが難しいものとなってしまいます。また、何度も同じ曲を繰り返し聞くということも、人々が繰り返して同じ音楽を聴くことが好きであることの表れということができます。

・2:変化

いくら繰り返しが好きであっても、同じフレーズが際限なく繰り返されるとそれは「退屈感」を招くものとなってしまいます。そのため、良い音楽には適度な変化も必要です。

By Newman University

機械学習に音楽を学習させる際には多くの場合、無料で公開されている楽曲データ(MIDI/MusicXML)が使われることが多いとされていますが、ハッチンソン氏はこの手法は間違いであると考えているとのこと。それは、音としての音楽をデータ化する際に情報が失われてしまうということに加え、ネット上にあるデータの多くは音楽ファンによって作られたものであったり、音楽初心者のために書かれた譜面をもとにデータ化されたものであったりするという現状にあるとハッチンソン氏は述べています。

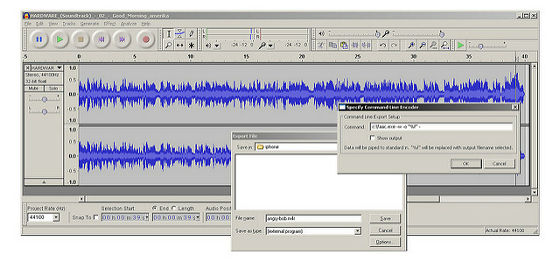

また、楽譜データではなくオーディオデータによる学習を行う上でも課題は存在するとハッチンソン氏は指摘。CDの場合、音をデジタルデータに変換する際には1秒あたり4万4100個のデータが作成されます。これは「サンプリング周波数」と呼ばれるもので、CDの場合は「44.1 kHz」という風に表現されます。この値が下がると音質が低下することに加え、音楽そのものが持っていた情報が失われるという問題がありますが、コンピューターがデータを取り扱うことの難しさは低下します。逆に、サンプリング周波数をあげると音楽の情報量は増加しますが、コンピューターに求められる仕事量は増加します。

By Patrick Lauke

Google傘下のDeepMindが開発した「WaveNet」や、Baiduによる「DeepSpeech」などは人間とほぼ聞き分けがつかない自然な人工音声を作り出すことが可能ですが、音楽の場合はそううまくはいかないとのこと。実際にピアノを使った音を作ることはできても、そこに「音楽性」が再現されているかと問われると、まだまだ改善すべき点が多く存在するとハッチンソン氏は指摘しています。

「評価」ということの難しさも、音楽と機械学習をうまく結び付けるに至っていない要因の1つであるとのこと。多くの人にとって、「なぜその音楽が好きなのか」を言葉で的確に表現することは容易ではありません。ハッチンソン氏は統計学を用いることでこの問題を解決しようとしたそうですが、わかったのは音楽解析や作曲を行わせるのに使用されているデータセットは「人々が全く聞きたいとは思わないような音楽ばかりで占められていた」という事実だそうです。はたして、そのようなデータセットを使って行われた学習で良い音楽を生み出すことができるのか、ハッチンソン氏は疑問を投げかけています。

さらに大きな問題「文化的バイアス」の存在をハッチンソン氏は挙げています。世界各地の文化には多くの場合、それぞれ特徴のある形態の音楽を持っています。これはおそらく多くの人が肌身で感じられることであると思われますが、一方で文学や絵画には音楽ほどの文化間における違いはないというのが興味深いところです。

そして音楽の評価という点について難しいのは、機械学習で音楽を扱う際に用いられているのは、過去数百年で生み出されてきた西洋音楽に大きく偏っているという状況があるとハッチンソン氏は指摘しています。

By Elek László

・関連記事

世界初の人工知能が作ったポップソング「Daddy’s Car」と「Mr Shadow」がYouTubeで公開中 - GIGAZINE

ジャズを自動作曲する人工知能「deepjazz」、AIが作ったジャズはこんな感じ - GIGAZINE

「バッハっぽさとは何か?」をAIに理解させることを可能にする330曲・100万音分のデータセットが公開される - GIGAZINE

今まで未解明だった「音楽」が脳で処理されるメカニズムが明らかに - GIGAZINE

音楽好きなら知っておきたい、音楽を聴く心理に隠された驚くべき7つの真実 - GIGAZINE

同じ音楽を繰り返し聞きたくなるメカニズムとは? - GIGAZINE

・関連コンテンツ

in ソフトウェア, 創作, Posted by darkhorse_log

You can read the machine translated English article Reason why it is not easy for computers ….