自分のPCで実行可能なローカルAIが一発で分かる便利サイト「CanIRun.ai」、比較機能もあってグラボの買い替え検討にも有用

AIの主流はChatGPTやGeminiなどのクラウドサービスですが、「利用制限に縛られずにAIを実行したい」とか「オフラインでもAIを実行したい」といった事情からローカルでAIモデルを実行するユーザーも数多く存在しています。ローカルで実行できるAIモデルの種類はPCのスペックによって変化しますが、AIモデルの種類が多すぎて「自分のPCでどのAIモデルが動くのか分からない」という状況に陥りがち。そんな時に役立つウェブサイトが「CanIRun.ai」で、アクセスするだけでPCの構成を検出して実行可能なAIモデルを教えてくれます。

CanIRun.ai — Can your machine run AI models?

https://www.canirun.ai/

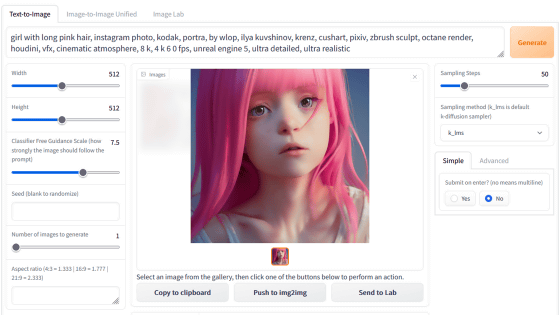

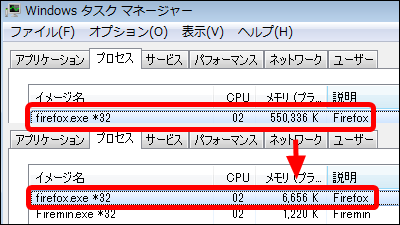

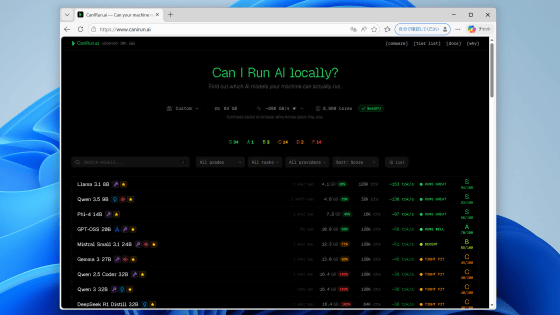

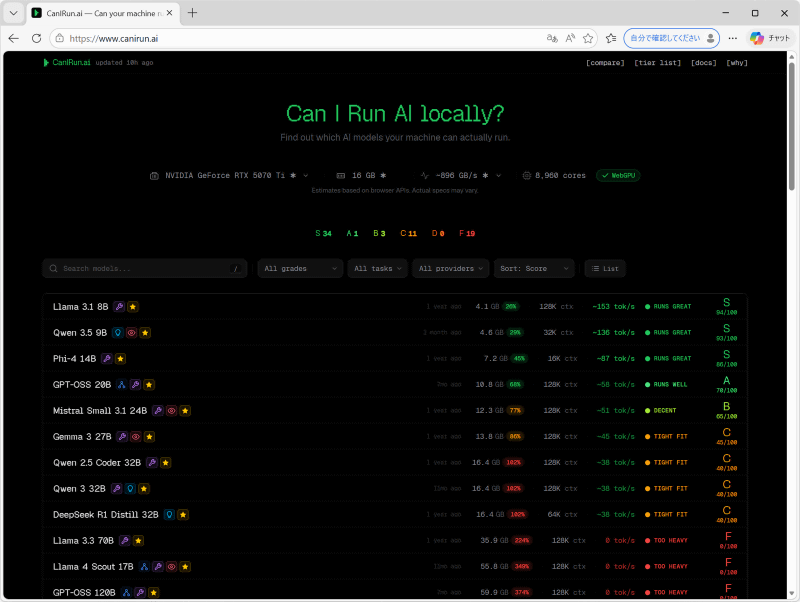

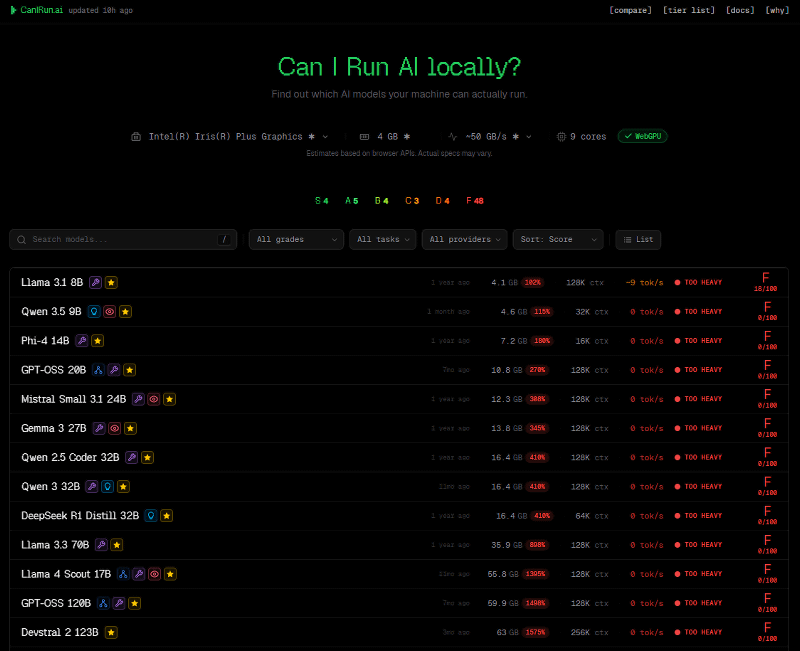

CanIRun.aiにアクセスすると、自動的にPCのパーツ構成が読み取られ、各種AIモデルの動作可能性が表示されます。なお、Firefoxだと構成読み取りに失敗することがあったので、EdgeやChromeでアクセスすることを推奨します。

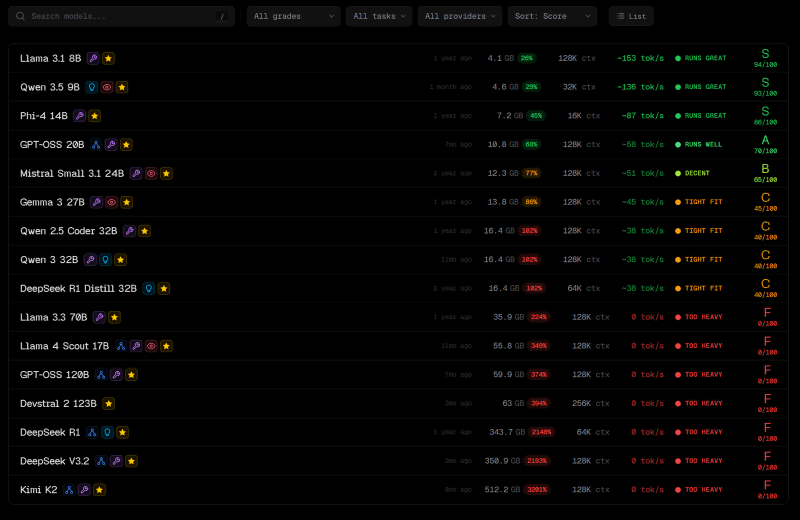

動作可能性はS~Fの6段階で表示されます。Sだと「このPCで非常に快適に実行可能なAIモデル」、Fだと「このPCにとって重すぎるAIモデル」ということを示しています。GeForce RTX 5070Tiを搭載したPCの場合、Llama 3.1 8BやQwen 3.5 9Bといったモデルなら快適に実行できるものの、Llama 3.3 70Bやgpt-oss 120Bは重すぎるということが分かります。

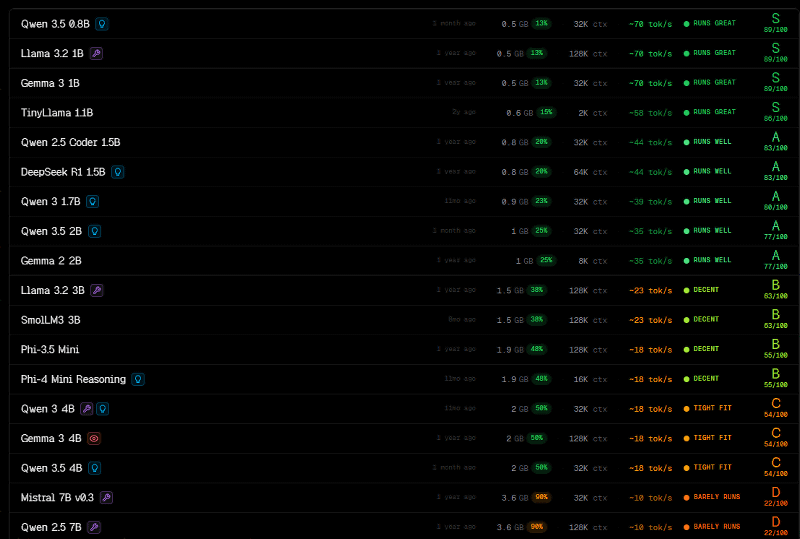

試しに専用GPUを搭載していないノートPCでアクセスしてみたところ、中量級以上のモデルは軒並み動作困難でした。

Qwen 3.5 0.8BやLlama 3.2 1Bといった軽量モデルならノートPCでも快適に実行できます。

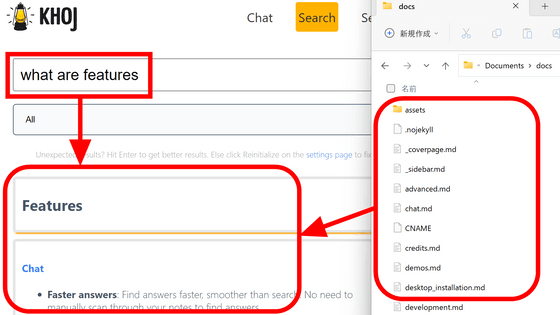

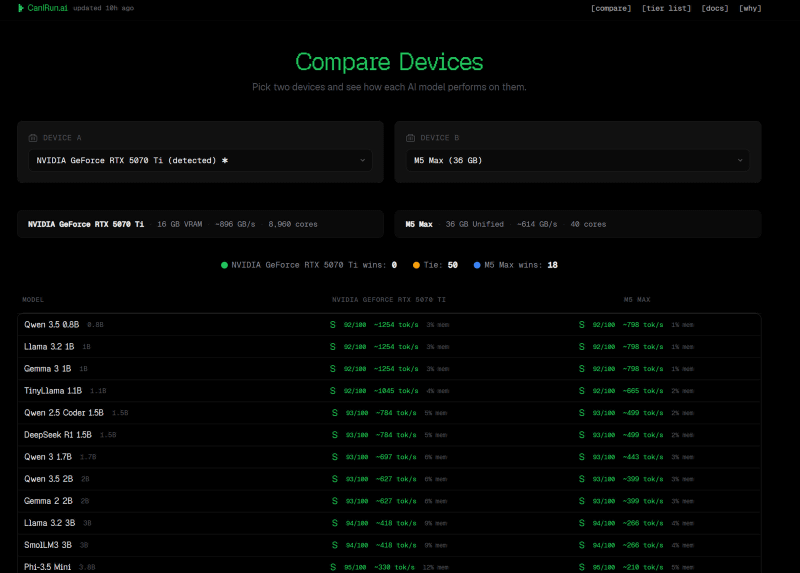

CanIRun.aiにはGPUの比較ページも用意されています。初期状態だと、自分のPCに搭載しているGPUとAppleのM5 Max(メモリ36GB)の比較が表示されます。

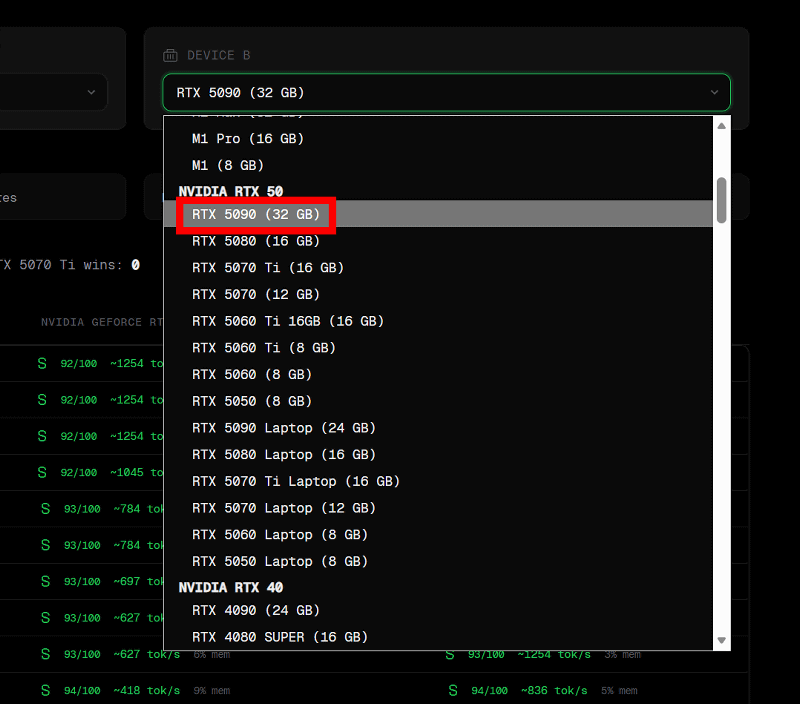

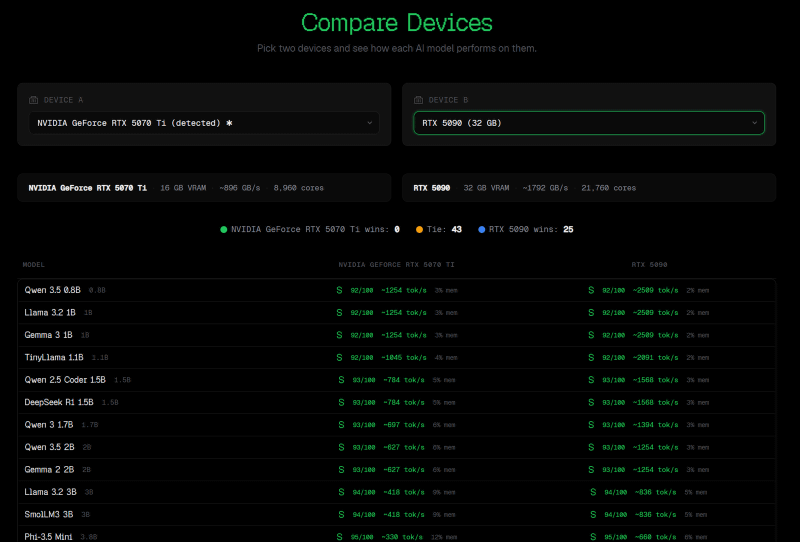

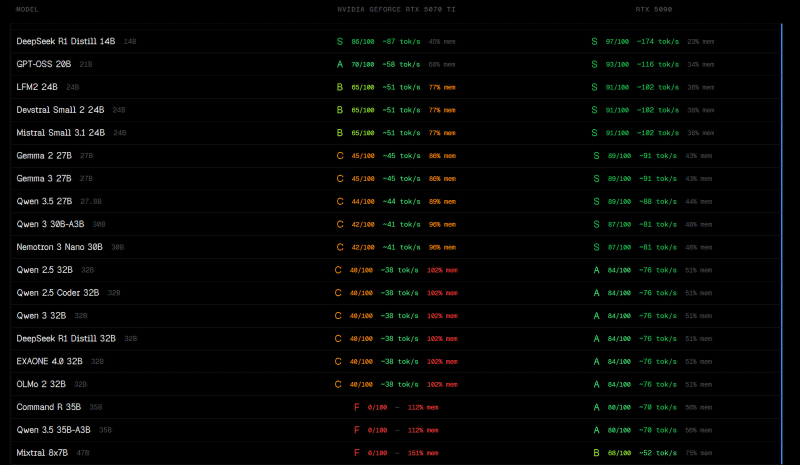

比較対象は自由に選択可能。今回は「GeForce RTX 5070TiからGeForce RTX 5090に買い替えたらどうなるか」ということを調べるためにプルダウンメニューから「RTX 5090 (32GB)」を選択しました。

各モデルの動作可能性と1秒当たりの処理トークン数がズラリと表示されます。GeForce RTX 5090はGeForce RTX 5070Tiの約2倍の速度で生成処理を実行可能であることが分かります。

GeForce RTX 5070Tiでは動作困難なQwen 3.5 35B-A3Bのような重量級モデルでもGeForce RTX 5090なら快適に実行できます。

CanIRun.aiはWebGPU APIなどを活用してPCのパーツ構成を取得しています。詳しい仕組みは以下のリンク先にまとまっています。

Why — CanIRun.ai

https://www.canirun.ai/why

・関連記事

システムのメモリ・CPU・GPUに合わせて適切なAIモデルを教えてくれるターミナルツール「llmfit」 - GIGAZINE

OpenAIのオープンウェイトモデル「gpt-oss」はOllamaを使って個人用PCで簡単に使用可能 - GIGAZINE

WebLLMを使ってクラウドもAPIキーも不要なAIブラウザ自動化ツール「On-device AI browser」 - GIGAZINE

Windows・macOS・Linux・Android・iOSと連係しさまざまな操作ができセルフホスト可能なパーソナルAIアシスタント「OpenClaw」 - GIGAZINE

画像生成AIをPCで簡単に実行できる「ComfyUI」のインストール手順&最初の画像を生成するまでの手順まとめ - GIGAZINE

iPhoneやMacで重量級画像生成AIをローカル実行できる「Draw Things」を使ってみたよレビュー、Qwen Imageのような大型モデルも実行可能 - GIGAZINE

・関連コンテンツ

in ハードウェア, ネットサービス, レビュー, ウェブアプリ, Posted by log1o_hf

You can read the machine translated English article CanIRun.ai is a handy website that lets ….