カメラに写った被写体の情報を表示して翻訳やWi-Fiパスワード認識まで可能な新機能「Google Lens」が発表される

カメラを被写体に向けると「目の前にあるのは何か」ということを認識してユーザーに教えてくれる新機能「Google Lens」が、Google I/O 2017で発表されました。

Google Lensがどんなものなのか?という説明は、以下のムービーの47分50秒あたりから、実際にGoogle Lensを使用している様子は1時間1分45秒あたりから見ることが可能です。

Google I/O'17: Google Keynote - YouTube

Google I/O 2017で発表された新機能「Google Lens」。これは、まずGoogleアシスタントとGoogleフォトに実装されるものです。

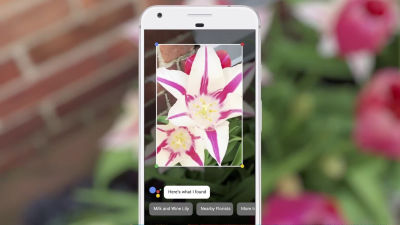

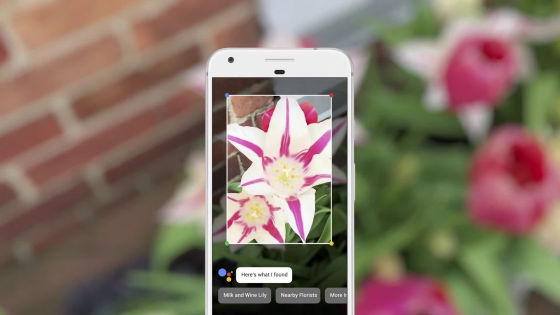

例えば、花にスマートフォンのカメラを向けると、カメラが花の形を認識し……

「見つけたのはこれです」ということで、被写体が何であるかの候補をディスプレイに表示してくれます。

さらに、Wi-Fiのネットワーク名とパスワードにカメラを向けると……

ネットワーク名とパスワードを自動的に認識。同時に、「NO THANKS 」「COPY TEXT」「CONNECT」という選択肢が表示されるので、「CONNECT」を選択。

すると、一発でWi-Fiに接続できました。もうパスワードとスマートフォンのディスプレイを何度も見返しながら打ち込む必要はなくなるというわけ。

さらに、道を歩いている時にたまたま見かけたお店でも、カメラを向けるだけでディスプレイ上にお店の情報を表示してくれます。

さらに、実際に壇上ではGoogle Lensのデモンストレーションも行われました。例えばアメリカ出身の人が旅行で大阪を歩いていて、「たこ焼き 6個入り 130円」の看板を発見したとします。

カメラを向けると、「私は日本語を話せますよ!翻訳してみましょう」と表示されるので「Translate this」をタップ。

すると、表示が「Octopus dumplings 6 pieces 130 yen」に変化しました。

Googleアシスタントに対して「それって何に見える?」と尋ねると……

たこ焼きという言葉とマッチする写真を複数表示してくれます。ユーザーが一度も「たこ焼き」という言葉を打つことなく、スマートフォンは会話の中で視覚的に「それが何か」を教えてくれるわけです。

また、Google Lensは「カメラが捉えているものが何か」を認識して、被写体にマッチするタスクの候補を提示してくれます。例えば、イベント告知に対してカメラを向けると、「チケットを入手する」という候補や、「予定をカレンダーに登録する」という候補を出してくれます。

「予定をカレンダーに登録する」をタップすると……

こんな感じで、ユーザーがほとんど作業することなく予定が登録されます。

なお、Google LensはまずGoogleアシスタントとGoogleフォトに実装され、その後ほかのプロジェクトでも使用される予定とのこと。機能が実装される時期については述べられていませんが、数カ月内には使えるようになるようです。

・関連記事

人・動物・車を識別してスマホに異常を知らせるスマートLEDライト搭載の防犯カメラ「Netatmo Presence」レビュー - GIGAZINE

Google翻訳アプリの新機能「リアルタイム カメラ翻訳」を使いまくってみた - GIGAZINE

どのアプリからもGoogle翻訳にアクセスでき、テキストをアプリ内でそのまま翻訳できる新機能「Tap to Translate」が登場 - GIGAZINE

Googleの人工知能や機械学習をスマホのカメラやお絵かきで体験できるデモ集「A.I. Experiments」 - GIGAZINE

VRに支配された恐るべき未来を描く「HYPER-REALITY」 - GIGAZINE

・関連コンテンツ

in 動画, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article A new function "Google Lens" that displa….