リアルタイムで表情を読み取って3Dアニメをグリグリ動かすムービー

リアルタイムトラッキング技術は日々進歩を続けており、ユーザーの手や指の動きを検知してPCを操作できるLeap Motionや、人間の表情をリアルタイムでトラッキングして2次元のキャラクターになりきるムービーなども続々と登場しています。CG技術の国際会議「SIGGRAPH(シーグラフ) 2014」では、カメラに写った人間の輪郭・目線・向き・表情などを、リアルタイムで読み取って3Dアニメーションの顔をグリグリ動かせる技術が浙江大学の研究チームから発表されています。個々のユーザーごとの顔データ入力は不要で、カメラに写った途端に誰でも3Dアニメーションを動かしているムービーも公開されています。

Displaced Dynamic Expression Regression for Real-time Facial Tracking and Animation

http://gaps-zju.org/DDE/

実際にユーザーの動きや表情を3Dアニメーションのデジタルアバターに反映して動かしている様子は以下から見ることができます。

Siggraph 2014: Displaced Dynamic Expression Regression for Real-time Facial Tracking and Animation - YouTube

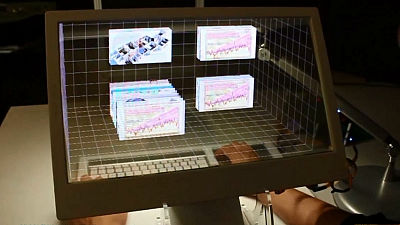

男性がウェブカメラを取り付けたPCの前に座りました。口を開けたり……

口角を引いて笑顔を作ったりすると、画面右側にある2つの顔が同時に男性と同じ表情を作っています。

表情を作ったまま顔の向きを変えることも可能。

男性が席を立ち、女性と入れ替わっても2つの顔は正確に女性の顔の動向をトラッキングしています。

ウインクもOK。

顔を上に向けても2つの顔は女性と同じ表情を作ります。

さらに対象者を交替して……

あれこれやってみても、全て正確にリアルタイムトラッキングしてアニメーションに反映できる技術、というわけです。

対象者の動きに合わせて表情を作っていた灰色のアニメーションは、あらかじめ男性がさまざまな表情を読み込ませたものがベースとなっています。

男性をもとに作られたベースによって、カメラに写った人物の表情をアニメーションとしてトレースできるわけです。

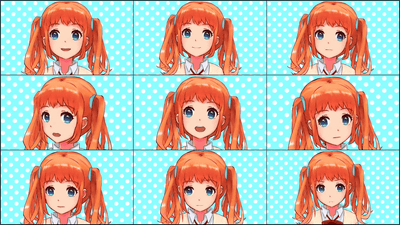

また、既存の表情認識システムと比べると、右端の浙江大学のシステムは正確に輪郭や唇のラインなどを認識しています。

「斜めを向いてウインク」や……

「顔を傾けてスマイル」など、異なる表情ごとに見るとリアルタイムトラッキングの精度がよく分かります。

このリアルタイムトラッキングシステムは、暗い場所や……

野外環境でも問題なく対象者を認識して3Dアニメーションやデジタルアバターに反映することができます。

手で顔を覆うとさすがに少しだけズレが生じますが……

サングラスをかけても全く問題なし、という優れモノです。

・関連記事

生アニメの可能性を感じる「みならいディーバ」のゲネプロを見てきた - GIGAZINE

人間の表情をリアルタイムでトラッキングして2次元のキャラクターになりきるとこうなる - GIGAZINE

空中で手を動かすジェスチャーだけでパソコンを操作できる「Leap Motion」を実際に使うとこんな感じ - GIGAZINE

手や指の動きで立体的に操作できる「Leap Motion」でシューティングゲームなどをプレイしてみました - GIGAZINE

ミクさんと自由におしゃべりしたりおさわりしたりできる「うちみく!ウチのミクさんが話を聞いてくれるようです」 - GIGAZINE

MMDモデルを3DCGでウェブ上に公開し閲覧者がアングルを動かしまくれるJavaScriptライブラリ「jThree」 - GIGAZINE

Kinectでスクリーンに投影した物を操作できる3D立体プロジェクターシステム「MirageTable」 - GIGAZINE

Kinectを使用して音声と手話をリアルタイムで翻訳する技術をMicrosoftが開発中 - GIGAZINE

手と指の動きを感知して奥行きまで含めた立体的な操作ができる「Leap Motion」は一体何がすごいのかまとめ - GIGAZINE

・関連コンテンツ

in 動画, アニメ, Posted by darkhorse_log

You can read the machine translated English article A movie that reads facial expressions in….