自動運転車を実現する開発ユニット「NVIDIA Drive PX 2」によるディープラーニングのデモはこんな感じ

NVIDIAがディープラーニングを使って外界の様子をリアルタイムで認識して自動運転車技術を開発できるユニット「NVIDIA Drive PX 2」をCES 2016に合わせて開催されたカンファレンスで発表しました。ディープラーニング技術を使ったデモを見れば、従来は数カ月かかった作業をわずか1日で終えるというNVIDIA Drive PX 2の凄まじさがよく分かります。

Live: NVIDIA's 2016 Las Vegas CES Press Event

http://blogs.nvidia.com/blog/2016/01/03/ces-las-vegas-event/

Automotive Innovators Motoring to NVIDIA DRIVE | The Official NVIDIA Blog

http://blogs.nvidia.com/blog/2016/01/04/automotive-nvidia-drive-px-2/

日本時間の2016年1月5日11時からカンファレンスがスタート。

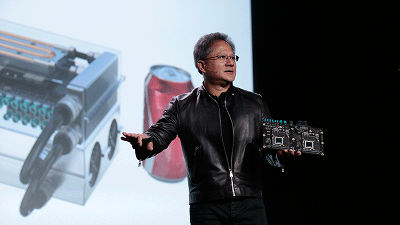

ジェン・スン・フアンCEOが登場。

自動運転車(セルフドライビングカー)の技術競争が世界中で起こっています。

GPUを使った演算処理能力を活用して自動運転車開発をサポートするNVIDIAは、新システム「NVIDIA Drive PX 2」を発表しました。

自動運転車の開発は、移動体の概念を変える革新的な技術。多くの命が奪われる交通事故を減らし、新しいパーソナルモビリティも誕生し、駐車場不足も解消できるなど快適な都市環境を実現できると期待されています。

NVIDIAによる自動運転技術の開発には2つのビジョンがあります。一つは、ドライバーが操作することなく目的地まで移動できる技術。そしてもう一つが、ドライバーなしで移動できる自動車。これは運送業や配車サービスで重宝されそう。

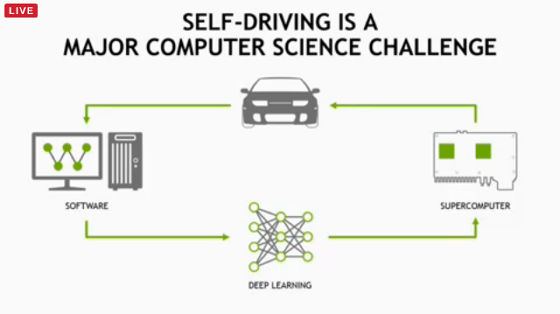

自動運転車に必要な技術は、地図や周囲の環境などをセンサーから得られる認識情報で処理すること。このプロセスは下の図のようなループを連続的に描くとのこと。

処理する情報量が膨大なため自動運転車の開発は極めて困難です。

特に、刻々と変化する周囲の状況を的確に判断することは極めて難しいもの。町には自動車だけでなく歩行者、バイク、自転車、放置された物体、野良犬などの不確定要素が満載です。これらを認識する技術が自動運転車実現の鍵を握るというわけです。

より具体的にはディープラーニング技術が解決すると考えられています。人間の脳のようなニューラルネットワークが視覚情報を処理して機械学習を行います。

この機械学習にはプログラミングは不要。さまざまな情報をインプットしてコンピューター自身がトレーニングを積む(深層学習する)ことでニューラルネットワークが進化。NVIDIA Drive PX 2のGPUによって、トレーニング速度は30倍から40倍に高速化。これまで数カ月かかったことがわずか1日で完了するとのこと。

AI開発競争はGoogle、Microsoft、IBM、BaiduなどのIT企業がこぞって参加。GoogleやMicrosoftによると、ニューラルネットワークはこの1年で音声認識やIQテストで人間の能力を上回ったとのこと。トレーニング速度の高速化は、AI開発の速度に決定的な役割を果たします。

NVIDIAのGPUユニットを使ってAIを開発するのはGoogleやMicrosoftなどの大企業に限られず、スタートアップから中小企業まで多種多様。

自動運転車の鍵はディープラーニングが、それを処理するGPUが握っているというわけです。

そこでNVIDIAはエンドツーエンドのディープラーニングプラットフォームを提案。単一のNVIDIAプラットフォームを使えば誰もがディープラーニングの開発に参戦できます。

NVIDIAのディープラーニングの処理能力は右肩上がり。わずか数カ月間で世界トップのレベルに到達したとのこと。

ここで画像処理技術開発を担当するマイク氏が登場。

NVIDIA Drive PX 2を使って車載カメラの映像を解析し、リアルタイムで路上の自動車を認識する様子を披露しました。

ニューラルネットワークのトレーニングのために学習させた物体は1億2000万個。GPUアクセラレーションがなければ数年はかかる作業だったとのこと。

検出できるのは自動車に限られません。歩行者や標識も識別可能。

道路との区別もバッチリ。

高速道路でのテストも楽々こなします。

すべてプログラムコードを書くことなくディープラーニングで実行しており、優秀なプログラマーを雇うよりもはるかに安上がりだとのこと。

ここで開発実例の紹介。アウディは4時間足らずでドイツの道路標識を学習し、96%という高い精度での識別が可能に。

ダイムラーは画像認識を完璧に成功させています。

日本のロボットタクシーもNVIDIAプラットフォームを利用。

他にもBMW、トヨタ、フォードなどもNVIDIAプラットフォームを利用し自動運転技術の開発を進めています。

ディープラーニングのフローは、GPUによる演算処理結果がクラウドベースのNVIDIA DRIVENETに上げられて、車載されたNVIDIA Drive PX 2にインプット。さらにNVIDIA Drive PX 2による学習内容が演算処理されてNVIDIA DRIVENETに蓄積され利用されるというように連続的に進化します。

自動運転車開発でのディープラーニングは、前後と屋根に合計4つ取り付けられた lidar(ライダー)と……

前後左右に搭載する合計6台のカメラから情報を得て行います。

4つのライダーが1秒間に4回スキャンすることで、周囲をライダーごとにリアルタイムで3D情報化。

リアルタイムで周囲様子を立体的に把握可能。もちろんこの作業は自動車の走行速度に合わせて3D処理されるため、極めて高い演算処理能力が問われそうです。

前後には魚眼カメラもアリ。

これらの情報をすべて統合することで、リアルタイムセンシングが可能というわけです。

車体前後のカメラによって、車両の前後を走行する他の自動車をトラッキング可能。

GPSを駆使しておおまかな走行位置を特定。

さらに、周囲の認識技術でどのレーンにいるのかというセンチメートルレベルでの位置情報の特定を狙っているとのこと。

これらに加えて高精度な地図情報をも取り込むと……

自動運転モードが可能に。

あらゆる外界の情報を超高速処理することが自動運転車の実現には必要で、NVIDIAはGPUによる超高速並列演算でこれを実現するというわけです。

ここでジャスティン氏が登場。

自動車の情報処理を説明。

下の画像は上下に前後のカメラ映像が映し出されており、中央のインフォメーターに自動運転車の外界認識情報が表示されています。

前後左右から近づく自動車を認識すると、黄色い表示で警告しています。

ディープラーニングを活用した自動運転車開発の説明が終わって、最後に新プラットフォーム「NVIDIA Drive PX 2」のハードウェアの紹介。

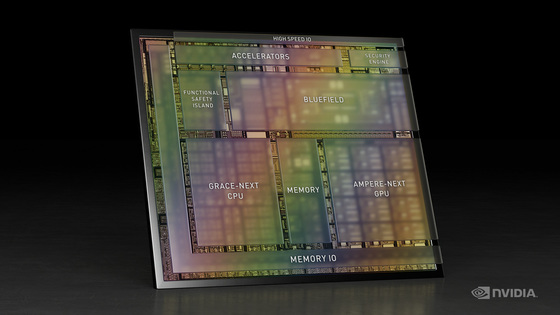

NVIDIA Drive PX 2はTITAN Xで採用された28nmプロセスをさらに微細化した16nm FinFETを採用。8テラフロップスの演算処理が可能な12個のCPUコアを搭載。

GPUはPascalを採用し、自動車のトランクに収まるサイズでMacBook Proの150倍の演算能力を誇ります。

ここで実機を披露。

NVIDIA Drive PX 2のメインボード。

水冷式の冷却機構をオプション採用しています。

NVIDIA Drive PX 2導入による自動運転車の公道走行試験は2017年に行われる予定で、一番乗りはボルボになるそうです。

開発ユニット「NVIDIA Drive PX 2」は、2016年第2四半期(4月から6月)に開発パートナーに提供され、2016年第4四半期(10月から12月)に一般販売が予定されています。

・関連記事

ボード1枚でMacBook Pro150台分の能力を持ち自動運転車を実現する「NVIDIA Drive PX 2」 - GIGAZINE

AppleのA8Xチップを上回り自動運転車もできるNVIDIAの「Tegra X1」は何がすごいのか? - GIGAZINE

自動運転を実現するGoogleの自動運転車の外界認識センサーはこんなにある - GIGAZINE

Googleの自動運転車は複雑な交通状況の市街地でもすでに実用レベルの自動走行が可能 - GIGAZINE

4KゲームPCやOculus Riftでの超絶VR体験など最上位グラボ「GTX980Ti」の圧倒的高性能ぶりを見せつけるNVIDIAブース - GIGAZINE

NVIDIAがGPUコア192基搭載の次世代モバイルSoC「Tegra K1」を発表 - GIGAZINE

2万円以下で購入できる世界最小スーパーコンピューターをNVIDIAが発表 - GIGAZINE

・関連コンテンツ

in ハードウェア, ソフトウェア, 乗り物, Posted by darkhorse_log

You can read the machine translated English article Demonstration of deep learning by the de….