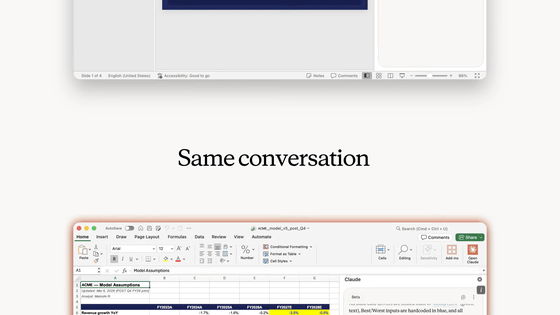

独自のチャットAI「Bard」を開発するGoogleが社員にチャットAIの利用について警告

Googleは独自のチャットAI「Bard」を開発していますが、社員がチャットAIを利用することに対して上層部から警告が発せられているとロイターが報じました。

Google, one of AI’s biggest backers, warns own staff about chatbots | Reuters

https://www.reuters.com/technology/google-one-ais-biggest-backers-warns-own-staff-about-chatbots-2023-06-15/

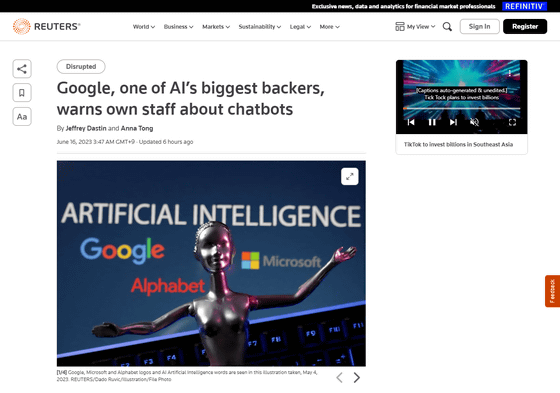

チャットAIの利用が世界的に活発になっている理由はメール・文書・プログラミングの作成などに役立てることで、タスクを大幅にスピードアップすることが期待できるためです。一方で、チャットAIはしばしば誤った情報や機密データ、著作権で保護された情報などを出力するケースがあるため、利用に慎重になるべきという声も上がっています。

GoogleはBardをはじめとするさまざまなAIツールを開発していますが、その一方で、Bardを含むチャットAIの使用について従業員に警告していると、事情に詳しい4人の関係者がロイターに語りました。情報筋によると、Googleの親会社であるAlphabetは従業員に対して自社の機密資料をチャットAIに入力しないようにと助言しているそうです。

BardやChatGPTなどのチャットAIは、ユーザーとの会話内容をベースにトレーニングされているため、一度入力した内容がのちのち知らないところで出力される可能性がある、つまりは情報漏洩(ろうえい)のリスクが生じる可能性があると度々指摘されています。Alphabetが従業員に対して自社の機密資料をチャットAIに入力しないようにと助言しているということは、この情報漏洩のリスクを認めたようなものです。

この他、AlphabetはチャットAIが生成するコードを直接使用することも避けるようにとエンジニアに警告していることが明らかになっています。

この件についてロイターがGoogleにコメントを求めたところ、「Bardは望ましくないコードの提案を行う可能性があるものの、それでもプログラマーにとって有用である」と返答したそうです。また、Googleは「自社技術の限界について透明性を保つことを目指している」と述べ、これらの情報は隠しているわけではないと主張しています。

これに対してロイターは、「Google側の懸念は、同社がChatGPTの競合ツールとしてリリースしたBardによるビジネス上の損害をいかに避けたいと考えているかをよく示しています」と指摘。

ロイターによると、GoogleのようにチャットAIの利用に制限を設けている企業は世界的に増えており、SamsungやAmazon、ドイツ銀行、Appleといった世界的な企業がこれに含まれるそうです。

GoogleとMicrosoftは企業顧客向けに対話型のAIツールを提供しており、これはデータをトレーニングに利用することを控えているため、情報漏洩のリスクはないものと考えられています。しかし、これの利用には高額な費用がかかります。

また、アメリカに本拠地を置くトップ企業を含む1万2000人近くの回答者を対象とした調査によると、2023年1月時点で専門家の約43%がChatGPTなどのAIツールを使用していると回答しており、その多くが上司に内緒でAIツールを利用していることが明らかになっています。

Insiderの報道によると、Googleは2023年2月のBardリリース前の内部テストを行っている段階でも、従業員に対して「内部情報を入力しないように」と指示していた模様。

なお、2023年6月1日に更新されたGoogleのプライバシー通知にも「Bardとの会話に機密情報を含めないでください」という記載が追加されているそうです。

Microsoftのマーケティング責任者であるユスフ・メディ氏は、企業が従業員にチャットAIを業務で使用してほしくないと考えるのは「当然」とコメントしています。なお、Microsoftは自社製のものを含むAIプログラムに従業員が機密情報を入力することを全面的に禁止しているかどうかに関するコメントを控えていますが、同社の別の幹部は「個人的に利用を制限している」とロイターに語ったそうです。

ちなみに、世界的なコンサルティング企業であるマッキンゼーではChatGPTを初めとしたジェネレーティブAIの利用が積極的に進められており、社員の50%はジェネレーティブAIを使用しているそうです。

世界的なコンサル企業が「社員の50%はジェネレーティブAIを使用している」と明言 - GIGAZINE

一方、 機械学習に関する国際会議の1つであるInternational Conference on Machine Learningは、「ChatGPTのようなAIを使って科学論文を執筆することを禁止する」という方針を発表しており、先進的なAIツールの利用方針は企業や団体によってかなり異なります。

ChatGPTなどのAIで科学論文を書くことが国際会議で禁止に、ただし自分の文章の編集・推敲はOK - GIGAZINE

・関連記事

GoogleがChatGPTのライバルとなる会話型AI「Bard」を発表 - GIGAZINE

GoogleがChatGPTのライバル「Bard」の一般公開を開始、実際に質問するとどんな答えが返ってくるのか? - GIGAZINE

GoogleのAI「Bard」はChatGPTよりもパズルを解くのがはるかに下手 - GIGAZINE

ChatGPTやBardなど複数のチャットAIへ同時に質問して結果をずらっと比較できる「ChatALL」を使ってみたよレビュー - GIGAZINE

Googleの対話型AIのBardが「Bardはもう終わりました」と発言してしまう、しかも情報源はChatGPTが出力したテキスト - GIGAZINE

Googleの対話型AI「Bard」を「病的なウソつきで役に立たない」とGoogle社員自身がリリース前に評価していたことが暴露される - GIGAZINE

Googleの対話型AI「Bard」がバックグラウンドでコードを実行できるようにする「暗黙的なコード実行」を導入、文字列の操作や論理・推論を含む複雑なタスクに対する回答精度が向上 - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by logu_ii

You can read the machine translated English article Google, which develops its own chat AI '….