機械学習アルゴリズムがオーケストラの演奏を再構成した幻想的な音楽を作り出す

アメリカ・ロサンゼルスを本拠地とするオーケストラのロサンゼルス・フィルハーモニックが創立100周年を迎えることを記念して、機械学習アルゴリズムが膨大な量のロサンゼルス・フィルハーモニックによる演奏記録を再構成した音楽を、芸術的な3Dビデオと共に披露しています。

New World Notes: Watch: Machine Learning Music Composed from Re-synthesized Fragments from 100s of Terabytes of LA Phil Recordings

https://nwn.blogs.com/nwn/2019/01/wdch-dreams-robert-thomas-la-phil.html

New World Notes: Now in LA: Experience Awesome 3D Video & Machine Learning-Based Music Projected on the Walt Disney Concert Hall -- Adaptive Sound Artist Robert Thomas on How the Soundtrack Was Created

https://nwn.blogs.com/nwn/2018/09/wdch-dreams-robert-thomas-ai-machine-learning-adaptive-music.html

1919年に設立されたロサンゼルス・フィルハーモニックは2019年に100周年を迎えます。そこで2018年の9月28日から10月6日にかけてロサンゼルス・フィルハーモニックは、本拠地であるウォルト・ディズニー・コンサートホールの壁面に3D映像を投影すると同時に音楽を流し、100周年式典の開催を知らせるパフォーマンスを行いました。

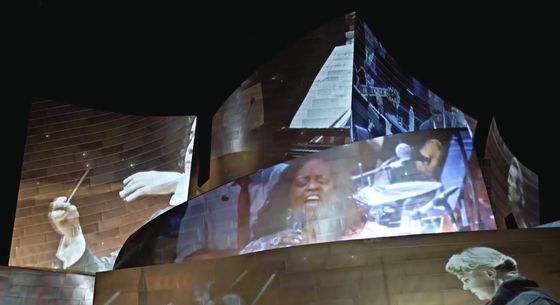

パフォーマンスは毎晩19時30分から23時30分までの間に30分間隔で行われ、行き交う人々は無料で壮大なパフォーマンスを目にできたとのこと。3D映像はメディア・アーティストのRefik Anado氏が制作し、映像と共に流す音楽はロサンゼルス・フィルハーモニックが過去に演奏した音源から、サウンドアーティストのRobert Thomas氏が「機械学習アルゴリズムを利用して」再構成したものだったそうです。

実際に機械学習アルゴリズムを利用して作られた音楽と共に、ウォルト・ディズニー・コンサートホールのメタリックな壁面に3D映像が投影された様子を捉えたムービーがこれ。

WDCH Dreams: Relive the Full Epic Performance in HD!

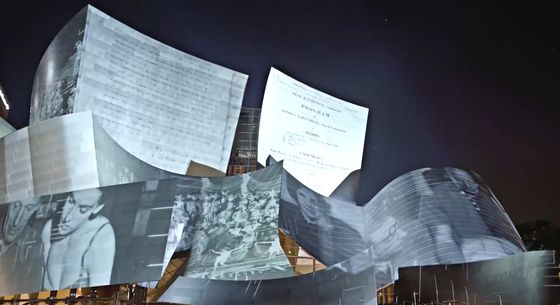

いくつもの立体が地面から突き出たように見えるウォルト・ディズニー・コンサートホールの壁面に、文字が投影されているのがわかります。

すると、突然プログラムコードのようなものが一面に映し出されました。

同時にオーケストラの音源からサンプリングしたらしき音楽が流れ始め……

壁面の映像は瞬く間に様相を変化させていきます。

SF映画に流れるような金属的な音の背景に、オーケストラを感じるハーモニーが流れます。

実際にコンピューター上で音楽を編集する際に現れる、音の波形らしきものも登場。

ロサンゼルスのど真ん中で、壮大なインスタレーション作品が展開されていたことがわかります。

思わずスマートフォンで撮影する人も少なくありません。

しばらくするとどこかで聞き覚えのあるようなフレーズも登場してきますが、複雑な編集を経て再構成された音楽はつかみ所がなく、再び機械的な響きに戻ってしまいます。

3D映像の素材には、これまでにロサンゼルス・フィルハーモニックが演奏した際の映像も使われていました。

20世紀前半と思われる、ロサンゼルス・フィルハーモニック初期の写真も登場。

幻想的な光景と不思議な音楽に魅了され……

多くの人々が集まった様子。

3D映像の終盤になるにつれて音楽も盛り上がっていき……

最後には映像内のオーケストラと音楽が一致した動きを見せて終了しました。

Thomas氏が今回の音楽を作るにあたって、コンピューターを使った研究者兼アーティストであるParag Mital氏に協力を依頼し、数百TB(テラバイト)ものデータを検索できるブラウザを作成してもらったとのこと。これによって演奏のさまざまな部分を取り出してオーディオ分析を行い、機械学習アルゴリズムを用いて抽出したサウンドクリップから新たな音楽を再構成する試みを実行したそうです。

たとえば最終的にインスタレーションで使用された音源の中には、ロシアの作曲家であるイーゴリ・ストラヴィンスキーが作曲した「春の祭典」の一部分が聞こえる箇所があるものの、機械学習アルゴリズムによってすぐさま原曲にないメロディーに移ってしまうとThomas氏は述べています。

また、音源を作成する別のプロセスでは選択した音楽ファイルを波形に変換してから機械学習アルゴリズムを使用して新たな音楽ファイルを作るなど、Thomas氏は音楽を作る上で機械学習アルゴリズムを用いたさまざまな試みに挑戦したとのこと。アルゴリズムを用いて音楽を作成することで、人間のアーティストが思いも寄らないような幻想的で不思議な音源になったようです。

・関連記事

機械学習でコンピューターが音楽を理解することが容易ではない理由 - GIGAZINE

世界初の人工知能が作ったポップソング「Daddy’s Car」と「Mr Shadow」がYouTubeで公開中 - GIGAZINE

ジャズを自動作曲する人工知能「deepjazz」、AIが作ったジャズはこんな感じ - GIGAZINE

「バッハっぽさとは何か?」をAIに理解させることを可能にする330曲・100万音分のデータセットが公開される - GIGAZINE

機械学習を使って全く新しい音作りを可能にする新概念シンセサイザー「Google NSynth Super」 - GIGAZINE

初心者向け「機械学習とディープラーニングの違い」をシンプルに解説 - GIGAZINE

・関連コンテンツ