「ツイートをAIで学習してテスラに役立てる」とイーロン・マスクが発言

by Alpha Photo

Twitterとテスラを所有するイーロン・マスク氏が「Twitterの公開ツイートを使ってAIモデルをトレーニングする」と発言し、データを活用して自身が設立した新しい人工知能企業・xAIとテスラがソフトウェア開発で協力するとの方針を示しました。

Elon Musk Will Train His AI Project Using Your Tweets | PCMag

https://www.pcmag.com/news/elon-musk-will-train-his-ai-project-using-your-tweets

Elon Musk plans Tesla, Twitter collaborations with xAI

https://www.cnbc.com/2023/07/14/elon-musk-plans-tesla-twitter-collaborations-with-xai.html

Elon Musk says his new xAI firm will use Twitter data, work with Tesla

https://nypost.com/2023/07/14/elon-musk-says-his-new-xai-firm-will-use-twitter-data-work-with-tesla/

マスク氏は7月14日に設立したばかりのAI企業・xAIに関する質問に答えるディスカッションをTwitter Spaceで実施し、この中で「大小を問わず、AIを研究しているあらゆる組織がTwitterのデータをトレーニングに使っています。他の組織と同じように、私たちも公開ツイートをトレーニングに使うつもりです」と発言。他の組織がTwitterのデータをトレーニングに使うことは基本的にすべて「違法」とくぎを刺し、自身が所有するxAIのAIモデルをトレーニングするためにツイートを利用し、ソフトウェア開発のためにxAIがテスラと協力する予定だと明らかにしました。

マスク氏はxAIの運営を支援するためにGoogleやMicrosoft、OpenAIから12人近くのエンジニアや研究者を採用しており、今後数週間以内に「最初のリリース」に関する詳細情報を共有したいとの意向を示しています。xAIが何を生み出すのかについての明言は避けたマスク氏でしたが、xAIの目標は「消費者と企業の両方にとって有用なAIを開発すること」だとし、長期的なビジョンは「人間のように幅広いタスクを解決できるAIを開発すること」とマスク氏は述べています。マスク氏はまた、今後登場するAIが「真実を追究する」ものになることも強調しました。

マスク氏はまた、テスラがAIの機械学習やコンピュータービジョンのトレーニング用に開発しているスーパーコンピューター「Dojo」についても言及しました。テスラは既存のソフトウェアを改良したり、新機能を開発したりするために、顧客の車から得たビデオクリップやデータを利用しています。マスク氏は「xAIが開発すると思われる最終的なAI言語モデルは、政治的に正しいものではありません。私たちのAIは、たとえそれが物議を醸すようなものであっても、真実の答えを出すことができると思います」と述べました。

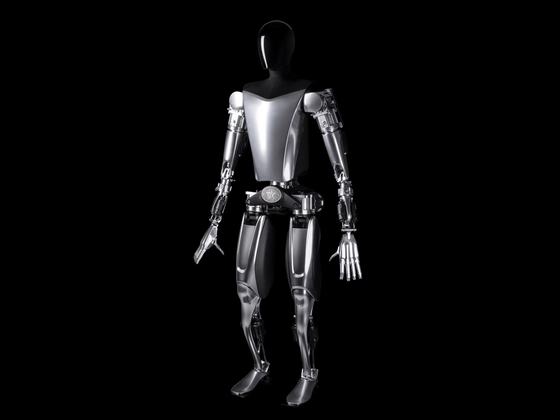

また、テスラは製造業での利用を目指して人型ロボットの「オプティマス」も開発中。Twitter Spaceの中でマスク氏はオプティマスについて「このロボットはまだ初期段階であり、『ユーザーが簡単に電源を切る方法』を模索中です」とユーモアを織り交ぜつつ答えています。なお、2023年7月19日に行われるテスラの決算説明会で、オプティマスに関する最新情報が共有される予定です。

・関連記事

Twitterの親会社であるXが「Twitterでデータスクレイピングを行い損害を与えた」として4人を提訴、1億3000万円超の損害賠償を求める - GIGAZINE

非ログイン状態でもTwitterを閲覧できるように - GIGAZINE

「オンラインで公開されたものすべてをAIのためにスクレイピングする」とGoogleが発表 - GIGAZINE

Twitterにバグがあり自分自身にDDoS攻撃を仕掛けていると専門家が指摘 - GIGAZINE

Twitterが1日に閲覧できるツイート数に制限を設ける、イーロン・マスクは理由を「極端なスクレイピングに対処するため」と説明 - GIGAZINE

・関連コンテンツ