AIツールで銃乱射事件の映像を変換した子ども向けアニメ動画が出回っている、SNSのモデレーションを回避する可能性大

AI技術を使って実在する暴力的な映像を子ども向けアニメーションに変換し、ソーシャルメディアに投稿する「Minion Gore(ミニオンゴア)」と呼ばれる現象が確認されています。投稿された動画群はアニメ映画「ミニオンズ」のキャラクターを無断で用いて暴力的な実写映像を加工したもので、プラットフォームの監視をすり抜けて拡散されている実態が報告されています。

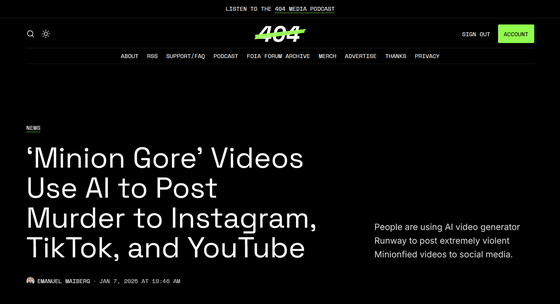

‘Minion Gore’ Videos Use AI to Post Murder to Instagram, TikTok, and YouTube

https://www.404media.co/minion-gore-videos-use-ai-to-post-murder-to-instagram-tiktok-and-youtube/

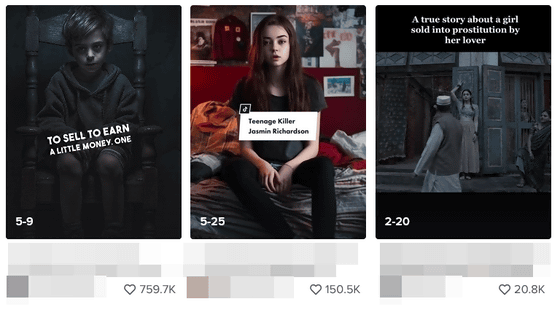

404 Mediaの調査によれば、ミニオンゴアの動画は2024年12月中旬から拡散が始まり、TikTokやInstagram、YouTube、Xといった主要なSNSプラットフォーム上で確認されています。

この「Minion Gore」現象の発端は2024年12月7日、TikTokユーザーが投稿した動画とされています。この動画はミニオンズ風の男性が踊るだけのものでしたが、10日間で5万回以上再生され、その後ロシアのユーザーを中心に同様の動画が急速に広がっていきました。

特に注目を集めたのは12月14日に投稿された動画で、2020年にFacebook上で配信された自殺映像をミニオンズ風に加工したものでした。この動画は3日間で25万回以上再生され、大きな反響を呼びました。その後も、エレベーター事故の映像や、ニュージーランドのクライストチャーチで発生したモスク銃撃事件の映像など、様々な暴力的コンテンツがミニオンズ風に加工され、拡散されていきました。

こうした動画の多くには、AI動画生成ツール「Runway」のウォーターマークが確認されています。制作者たちは同ツールのGen-3「video to video」機能を使用し、「make the clip look like one of the Minions animated movies(クリップをミニオンズアニメ映画風に見せる)」といったプロンプトで映像を変換しているとされています。

Minion Goreに対し、各プラットフォームは対策を講じています。TikTokは、AIで改変されたコンテンツであっても、コミュニティガイドラインに違反する暴力的なコンテンツは削除対象とする方針を示しており、記事作成時点でミニオン・ゴアの動画はすべて削除されています。

懸念されるのは、この手法が他のキャラクターにも応用され始めていることです。404 Mediaによれば、すでにミニオンズ以外のキャラクターを使用した類似の動画も確認されており、問題の広がりが危惧されています。カリフォルニア大学バークレー校のハニー・ファリド教授によれば、現行の映像認識システムではこうしたAI加工を施された映像の検出は困難だとのこと。

専門家からは、この現象が「潜在的なモデレーションの抜け穴」となる可能性が指摘されており、AIによる映像加工技術の発展に伴う新たな課題として注目されています。各プラットフォームは検出システムの更新や新たな対策の導入を進めていますが、技術の進化に追いつくことができるかが今後の課題となっています。

・関連記事

OpenAIは動画生成AI「Sora」で実在の人物が映る動画や既存のアーティストをまねる動画の生成を制限している - GIGAZINE

YouTubeが自分の顔や声を模倣したAI生成コンテンツの削除を要求できるようにポリシーを変更 - GIGAZINE

YouTubeが顔や声を含むクリエイターの肖像のコピーを防ぐAI検出ツールを発表、AIのトレーニングのためのスクレイピングも厳しく批判 - GIGAZINE

GPT-4oやGoogle Geminiに「自転車に乗ったペリカン」をSVG形式で描かせるベンチマークを試すとこんな感じ - GIGAZINE

Googleが最大4Kの動画を生成できるAI「Veo 2」を発表、人間による評価でOpenAIのSoraを上回る - GIGAZINE

・関連コンテンツ

in ネットサービス, Posted by log1i_yk

You can read the machine translated English article Children's cartoon videos of mass sh….