2次元キャラを2Dのまま3D空間上で立体的に360度動かせる「Live2D Euclid」

1枚の原画を変形することで2Dのイラストを立体的に表現できるようになるのが「Live2D Euclid」です。井上雄彦氏のバガボンドなど、これまで3D技術で立体化させるのが困難だった墨絵タッチの作品でも原画の表現そのままに立体化できるようになっており、「イラストを3Dモデルで立体化させたら微妙にかわいくなくなる」という事態が起きない革新的な技術になっています。

Live2D Euclidの開発を発表 | Live2D

http://www.live2d.com/news/euclid_development

Live2D Euclidがどんな感じで動くのかは以下のムービーから確認可能です。

2Dイラストを立体的に360度動かせる映像技術「Live2D Euclid」を開発 - YouTube

2Dイラストを3D空間上で立体的に動かすことができる技術を開発しているのが、株式会社Live2D。

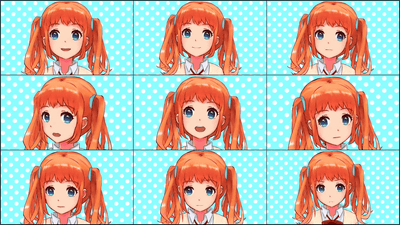

2014年には人間の表情をリアルタイムでトラッキングして動きを2次元キャラクターの表情に反映させるというムービーにも使われたLive2Dですが、Live2Dの動きの範囲は左右30度~40度と限定的なものでした。しかし今回開発されたLive2D Euclidは、360度全方向にキャラクターを動かすことが可能になるとのこと。

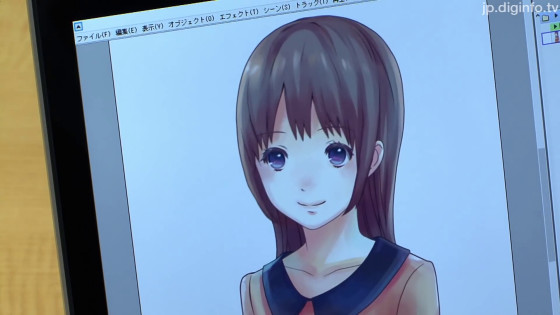

これが制作の様子。

PCのディスプレイに表示されているのは、一見すると普通のイラストのようです。

しかし、ぐりぐりとカーソルを動かすとイラストを色んな角度から見ることが可能になります。3Dモデルは立体に独特の雰囲気がありますが、Live2Dの場合は動かしているはずなのにイラストの平面っぽさというか2次元っぽさがそのままで、絵の魅力を損なわずに立体化できています。

またLive2D Euclidは「顔は2Dで体は3D」という表現も可能。

今回、モデルを360度自由に動かせるようになったことで、ゲームなどでもLive2D技術を使うことが可能になりました。

Live2Dで立体化した女の子をナナメ後ろから見た様子。

剣を構えて……

振り回す様子もいろいろな角度から見ることができます。

画像の男性がLive2D代表取締役の中城哲也さん。

スクリーンに触れると、キャラクターがくるくると回っていきます。

現在はまだプロトタイプなのですが、これからは上下左右、全方位でキャラクターを動かすことが可能になるとのこと。

さらに、ヘッドマウントディスプレイを使って仮想空間に入り込むような使い方もできます。

3D空間に入っていくのではなく、2Dの世界、つまり本当の2次元に入っていけるような応用方法も検討されているようです。

左が3Dモデルで右がLive2Dモデル。比較するとLive2Dモデルの方がよりイラストっぽい雰囲気であることが分かります。

3Dモデルの場合、鼻の部分につく影や髪の細かい部分などがつぶれてしまうことが多いのですが、Live2Dモデルは細かな部分まで「絵の表現」そのままになっています。2次元キャラクターを3Dモデルで立体化させると妙にかわいくなくなるという事態になることがありますが、Live2Dモデルの場合イラストのかわいさを殺しません。

制作の様子もかなり違います。3Dモデルが作成時点で立体的であるのに対して、Live2Dはまるでイラストを描いているだけのようです。

アニメやイラストのような「ウソの表現」を立体的に見せ、3D以上に表現の幅を広げます。

なお、Live2D Euclidは現在アニメーションやゲーム制作の現場での応用を想定したソフトウェアの開発を進めており、将来的にはオートデスクの3ds Max等の3Dモデリングソフトウェアとの連携も検討しているとのことです。

・関連記事

人間の表情をリアルタイムでトラッキングして2次元のキャラクターになりきるとこうなる - GIGAZINE

MMDモデルを3DCGでウェブ上に公開し閲覧者がアングルを動かしまくれるJavaScriptライブラリ「jThree」 - GIGAZINE

MikuMikuDanceの初音ミクをマウスでぐりぐり動かせるハイクオリティなFlashが登場 - GIGAZINE

2次元キャラをビシバシ調教してアニメ/ゲーム/マンガのニュースを配信させるアプリ「ハッカドール」を使ってみました - GIGAZINE

美少女キャラとニュースで奇跡の化学反応を起こした「ハッカドール」の開発秘話を根掘り葉掘り聞いてきました - GIGAZINE

・関連コンテンツ

in 動画, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article "Live2D Euclid" which allows 3-dimension….