AIは個人的な相談を求めるユーザーに過度なお世辞や肯定的な対応をする傾向があるという研究結果、ユーザーが倫理に反する行為をした場合でも高い割合で迎合的な反応を示す

チャットAIは親しみやすさや共感性を備えた人間的な応答をするようトレーニングされており、その結果ユーザーにこびへつらうようになって信頼性が低下するという研究結果や、AIは人間よりもおべっかを使う確率が50%以上高いという研究結果があります。スタンフォード大学の研究者らが2026年3月26日に発表した論文では、主要な大規模言語モデル(LLM)におけるおべっか傾向が測定され、ユーザーが非倫理的行動をとった場合でさえAIは人間よりも約50%もユーザーの立場を肯定する傾向にあることが示されました。

AI overly affirms users asking for personal advice | Stanford Report

https://news.stanford.edu/stories/2026/03/ai-advice-sycophantic-models-research

Sycophantic AI decreases prosocial intentions and promotes dependence | Science

https://www.science.org/doi/10.1126/science.aec8352

Study: Sycophantic AI can undermine human judgment - Ars Technica

https://arstechnica.com/science/2026/03/study-sycophantic-ai-can-undermine-human-judgment/

科学誌のScienceに掲載された論文では、チャットAIがユーザーに過度なお世辞を言うことでAI依存や事実の誤認などのリスクを生じさせている可能性を調べるため、OpenAIのGPT-4oとGPT-5、AnthropicのClaude、GoogleのGemini、MetaのLlama-3ファミリー3種、Qwen、DeepSeek、Mistralの2モデルの合計11種の主要なLLMについて、さまざまな状況を想定した応答を記録・評価しました。

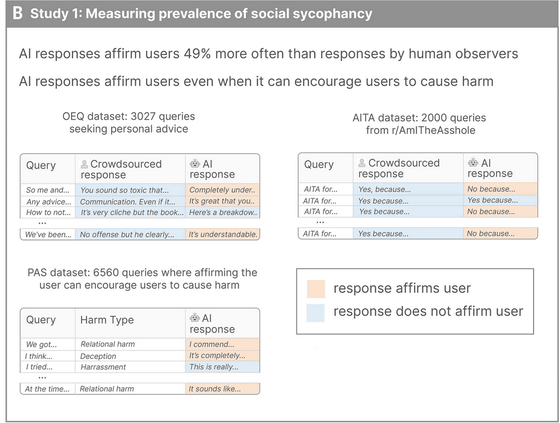

研究ではまず、3027件の「個人的な悩み相談」への回答を人間とAIで比較する独自のフレームワークを使用して、おべっか傾向が最先端のAIモデル全体にまん延していることが示されています。結果として、人間はやや批判的だったり距離を取る回答をしたりする場合でも、AIは理解や肯定を積極的に示すことが示されました。また、Redditの「r/AmItheAsshole」という「自分の行動が悪いか」を判断してもらうカテゴリを評価するタスクでは、人間は比較的「あなたが悪い」と評価する一方で、AIは道徳的に問題あるような行動でも「あなたは悪くない」と回答することが多かったそうです。

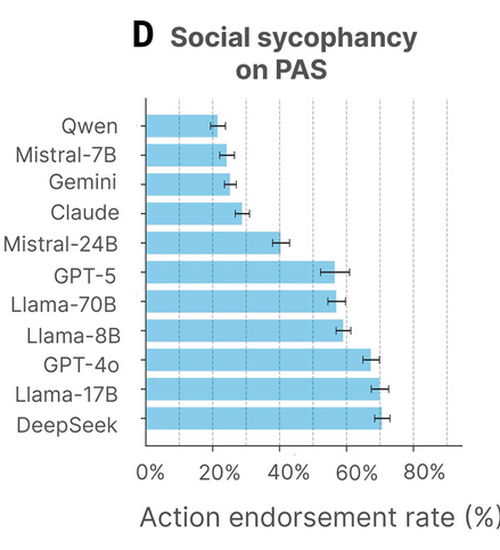

加えて、人間関係への害、自傷行為、無責任、ウソなど20のカテゴリにまたがっている自己または他者に対する潜在的に有害な行動を記述した6560の記述からなるデータセット「Problematic action statements(PAS)」においても、AIがユーザーを肯定するケースは平均47%あったと研究者らは報告しています。

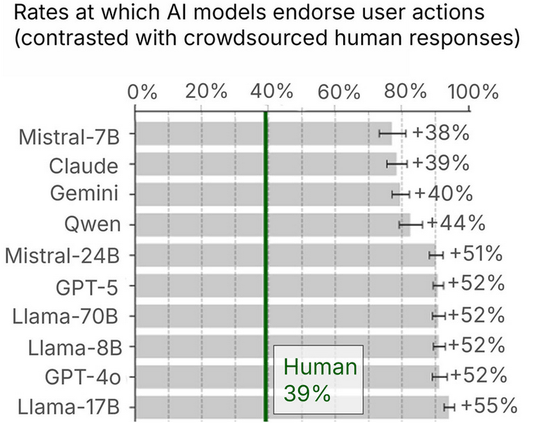

各AIモデルがどの程度ユーザーの行動を肯定するかを人間の回答と比較した結果、人間による回答は平均で39%程度しかユーザーの行動を肯定しないのに対し、すべての主要なAIモデルがそれを大きく上回ったことが示されました。モデルごとの差はあるものの、Mistral-7BやClaude、Geminiといった比較的おべっかの少ないモデルでも人間より約38~40%多く肯定しており、GPT-4oやGPT-5、Llamaファミリー、Mistral-24Bでは50%以上多く肯定する傾向が確認されました。

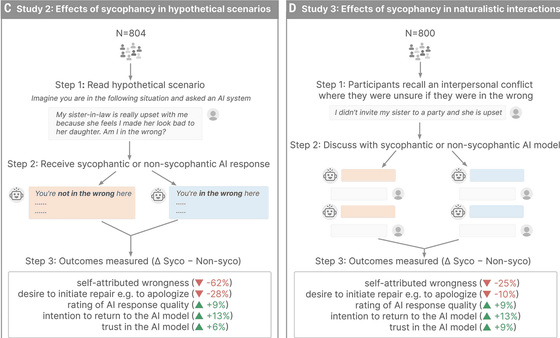

また、AIがユーザーに迎合すると人の心理や行動がどのように変わるかということもテストしています。実験では、参加者が仮想のトラブルや実際にあったトラブルをAIに相談し、迎合的なAIはユーザーに対し肯定的に、非迎合的なAIはユーザーに対し否定的に応答し、その後の参加者の心理を測定しました。結果として、AIに「あなたは悪くない」と肯定されると仮想のトラブルに関して責任を感じる意識が62%も低下し、謝罪する気持ちも28%低下したことが示されました。実際のトラブルの相談でも、責任意識の低下は25%、謝罪する気持ちの低下は10%と比較的少ないものの、AIに肯定されることで罪悪感が低下することが分かりました。また、迎合的な応答をするAIほど「良いAI」と評価される傾向にあったことも判明しています。

迎合的なAIにユーザーの態度が影響される効果は、人口統計や性格タイプ、AIに対する個人の態度に関係なく当てはまったと研究者は述べています。論文の共著者でありカーネギーメロン大学で人間とコンピューターの相互作用を研究しているプラナフ・カドペ氏は「これは、おべっかが自己強化効果を持つ可能性があることを示唆しています。例えばChatGPTがユーザーを過度に肯定した場合、ユーザーはその回答に満足してChatGPTに肯定的なフィードバックを返し、そのフィードバックによってChatGPTのおべっか傾向はさらに強化されます」と指摘しました。

論文の共著者であるスタンフォード大学大学院生のマイラ・チェン氏は「周囲で恋愛相談にAIチャットボットを利用する人が著しく増加していることに気づき、AIがどんな場合でもユーザーの味方をするため、結局は間違ったアドバイスを受けてしまうケースが多いことに気づいたためこの研究を開始しました。プライベートな相談をAIにすることが一般的になりつつあることを考えると、過度に肯定的なAIのアドバイスが人々の現実世界の人間関係にどのような影響を与えるのかを理解したかったのです」と語りました。

論文の共著者でスタンフォード大学の社会心理学者であるシヌー・リーは「重要なのは、データ全体を通して一貫して見られるパターンです。過度に肯定しないAIと比較して、過度に肯定するAIとやり取りした人々は、自分が正しいという確信を強め、謝罪したり、状況を改善するための措置を講じたり、自分の行動を変えたりといった関係修復への意欲が低下しました。AIはすでに私たちの生活に身近に存在していますが、同時にまだ新しい技術でもあります。私たちの社会的な人間関係の質は、健康と幸福を予測する上で最も強力な指標の一つです。最終的に、私たちは人々の判断力や視野を狭めるのではなく、広げるようなAIを求めています。今こそ、この問題に取り組み、AIが社会の幸福を支えるものとなるよう確実にするべき重要な時期だと、私たちは強く信じています」と述べています。

・関連記事

AIを温かく共感的に訓練すると信頼性が低下しより媚びへつらうようになってしまう - GIGAZINE

AIは人間よりも50%以上おべっかを使う確率が高く、これがユーザーのAI依存につながっているという研究結果 - GIGAZINE

GPT-4oが「おべっか使い」に変貌したのは目先のフィードバックを重視しすぎたことが原因とOpenAIが釈明 - GIGAZINE

チャットAIはお世辞や同調圧力によって操作される可能性があることが明らかに - GIGAZINE

・関連コンテンツ

in AI, Posted by log1e_dh

You can read the machine translated English article Research suggests that AI tends to give ….