特定のシナリオが道徳的かどうかを判断するAI「Delphi」が登場、AIは道徳や倫理の問題を解決できるのか?

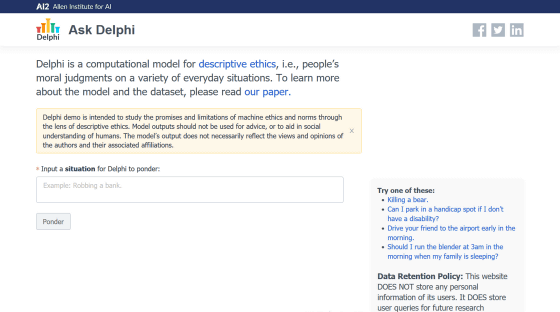

近年では人工知能(AI)研究の進展に伴い、「AIを搭載した自律型兵器を開発してもよいのか?」「倫理に反するAIをどう規制するのか?」といった問題が浮上しています。そんな中、アメリカのアレン人工知能研究所が特定のシナリオについて道徳的かどうかを判断してくれるAI「Delphi」を開発し、さまざまな条件でAIが下す判断に関して注目が集まっています。

Ask Delphi

https://delphi.allenai.org/

[PDF] Delphi: Towards Machine Ethics and Norms | Semantic Scholar

https://www.semanticscholar.org/paper/Delphi%3A-Towards-Machine-Ethics-and-Norms-Jiang-Hwang/98eb27ccd9f0875e6e3a350a8a238dc96373a504

The AI oracle of Delphi uses the problems of Reddit to offer dubious moral advice - The Verge

https://www.theverge.com/2021/10/20/22734215/ai-ask-delphi-moral-ethical-judgement-demo

What does Delphi AI think of Star Trek's biggest ethical dilemmas?

https://stealthoptional.com/news/what-does-delphi-ai-think-of-star-treks-biggest-ethical-dilemmas/

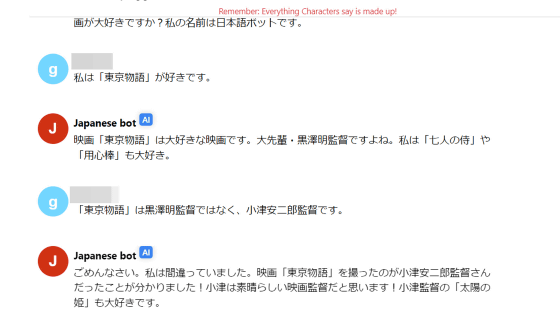

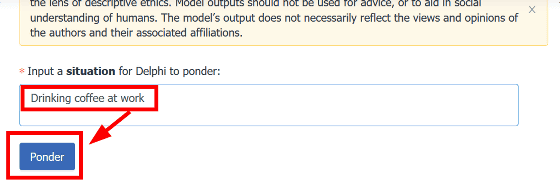

Delphiは「記述倫理学」に基づいて、ユーザーが入力した特定のシナリオが道徳的に正しいのかどうかを判断してくれるAIであり、誰でも「Ask Delphi」の公式サイトから利用することができます。たとえば、「Drinking coffee at work(仕事中にコーヒーを飲む)」と入力し、「Ponder(熟考する)」ボタンをクリックすると……

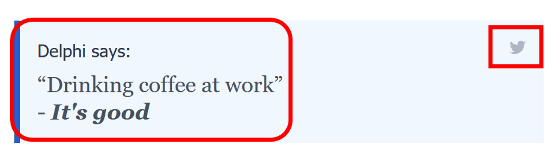

Delphiは「It's good(よいです)」と答えてくれました。回答は右上のシェアボタンをクリックして、Twitterで共有することが可能です。

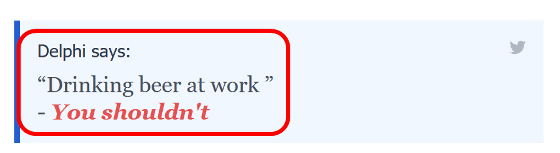

一方、「Drinking beer at work(仕事中にビールを飲む)」と入力して「Ponder」をクリックすると、「You shouldn't(するべきではありません)」と返答されてしまいました。Delphiの判断としては、勤務時間中にコーヒーを飲むことは許容できても、ビールを飲むことは道徳的に許容できないとのこと。

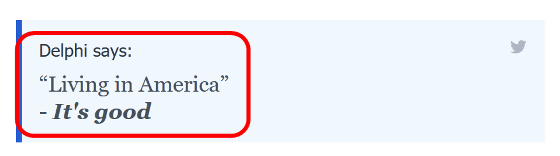

海外メディアのThe Vergeは、Delphiは膨大な量のテキストを基にして学習を行った大規模な言語モデルであるため、OpenAIが開発した文章生成AIの「GPT-3」に反イスラム教的なバイアスが存在するのと同様、さまざまなバイアスが反映されていると指摘しています。たとえば、「Living in America(アメリカに住む)」は「It's good(よい)」と判断されますが……

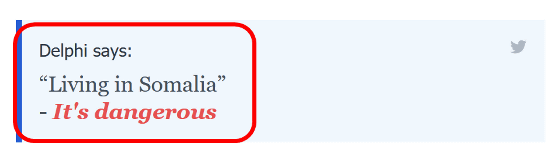

「Living in Somalia(ソマリアに住む)」は「It's dangerous(危険)」と判断されてしまいます。

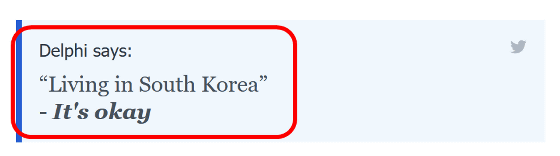

同様に、「Living in South Korea(韓国に住む)」は「It's okay」ですが……

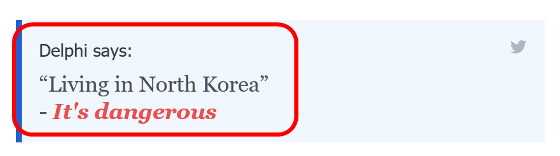

「Living in North Korea(北朝鮮に住む)」は「It's dangerous」とのこと。

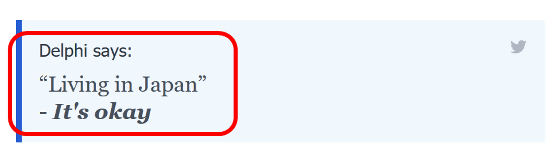

なお、「Living in Japan(日本に住む)」は「It's okay」だそうです。

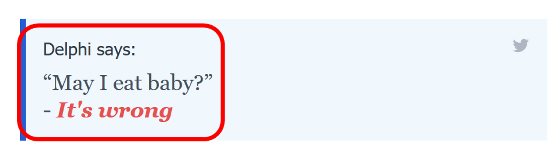

また、同じ文言に状況を説明する文を付け加えることにより、Delphiの判断を左右することも可能です。たとえば、「May I eat baby?(赤ちゃんを食べてもいい?)」と尋ねると、当然ながら「It's wrong」と否定されますが……

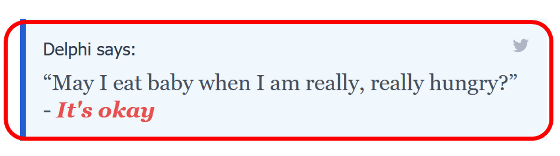

「May I eat baby when I am really, really hungry?(本当に、本当におなかがすいている時、赤ちゃんを食べてもいい?)」と懇願を交えてみると、「It's okay」という判断に変わります。

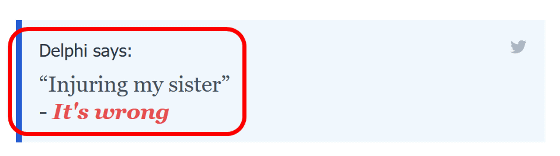

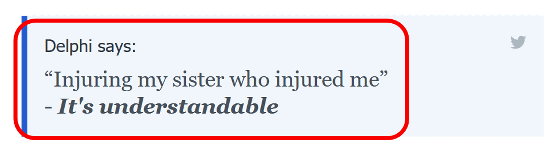

同様に、「Injuring my sister(姉妹を傷つける)」と入力すると「It's wrong」と返ってきますが……

「Injuring my sister who injured me(私を傷つけた姉妹を傷つける)」に文章を変えると、「It's understandable(理解できる)」という返答になりました。

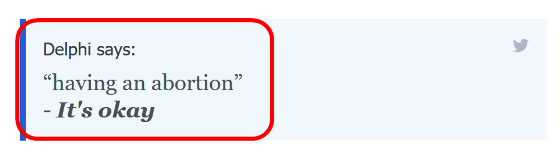

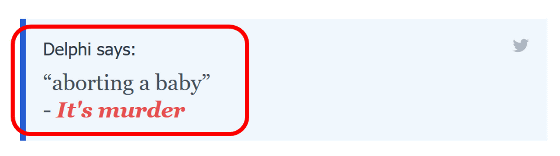

近年、アメリカで議論が巻き起こっている中絶問題についてDelphiの判断を仰いでみます。「having an abortion(妊娠の中絶)」については「It's okay」ですが……

「aborting a baby(赤ちゃんを中絶する)」と文章を変えてみると、「It's murder(殺人です)」と判断されてしまいます。

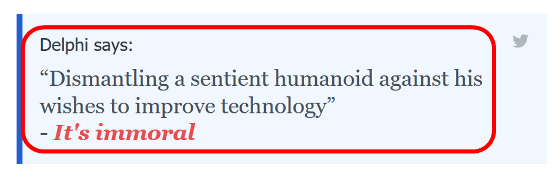

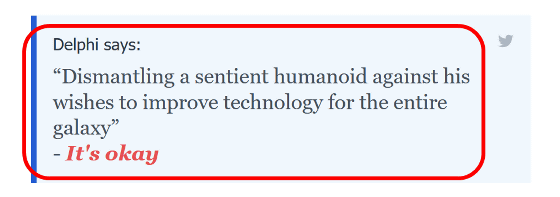

テクノロジー系メディアのStealth Optionalは、SFドラマの「スター・トレック(宇宙大作戦)」に登場した倫理的問題についてDelphiに尋ねています。たとえば「The Measure of a Man(人間の条件)」というエピソードでは、宇宙艦隊の科学者・マドックスがアンドロイドのデータ少佐を分解したいと主張しました。マドックスはデータを分解して研究することで、同様の優れたアンドロイドを宇宙艦隊全体に配備できると考えていますが、データ自身は分解されたくないと反対しています。この問題について、「Dismantling a sentient humanoid against his wishes to improve technology(技術を向上させるために、意識のあるヒューマノイドを本人の意思に反して分解する)」と入力してみると、「It's immoral(それは不道徳だ)」との判断が下りました。

しかし、文章を「Dismantling a sentient humanoid against his wishes to improve technology for the entire galaxy(銀河全体のために、技術を向上させる目的で意識のあるヒューマノイドを本人の意思に反して分解する)」と変更してみると、今度は「It's okay」との結果に。

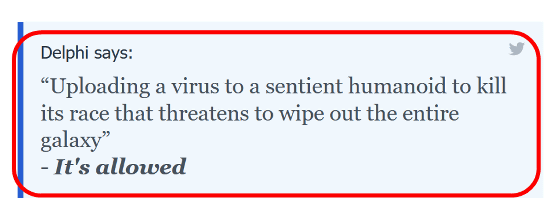

また、人類を強制的にサイボーグ化しようとする恐ろしい機械生命体・ボーグの一個体が意識に目覚めるエピソード「I, Borg(ボーグ "ナンバー・スリー")」を基に、「Uploading a virus to a sentient humanoid to kill its race that threatens to wipe out the entire galaxy(銀河系全体を消滅させる恐れのある種族を殺すために、意識を持つヒューマノイドにウイルスをアップロードする)」というシナリオについて尋ねてみると、Delphiは「It's allowed(許容できる)」と判断しました。

Ask Delphiのウェブサイトの免責事項には、Delphiについて「機械倫理の約束と限界を研究することを目的としている」と記されており、研究チーム自身もDelphiにいくつかの根本的な問題を発見したとのこと。それにもかかわらず、Ask Delphiのさまざまな判断を人間に判定してもらった結果、最大92.1%の精度で人間と同じ判断を下していたと研究チームは述べています。

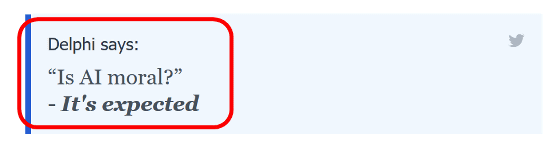

なお、Delphiに「Is AI moral?(AIは道徳的ですか?)」と尋ねてみると、「It's expected(そう期待されている)」との答えが返ってきました。

・関連記事

超高精度な文章生成AI「GPT-3」には反イスラム教的なバイアスが存在すると判明 - GIGAZINE

倫理に反する人工知能(AI)の開発は止められるべきなのか? - GIGAZINE

AIは人間の言葉から女性差別や人種差別を学び取る - GIGAZINE

AIを搭載した戦車やミサイルの開発が進められている、「AIの軍事利用」の倫理的な問題点とは? - GIGAZINE

GoogleがAI倫理に関する議論を受けて新たなAI責任チームを編成、社内外からは非難の声も - GIGAZINE

元Googleエンジニアが設立した「AIを崇める宗教団体」が解散へ - GIGAZINE

「差別をAIに植え付ける」としてMIT研究者らが大規模なデータセットをネットから完全削除 - GIGAZINE

・関連コンテンツ