Appleが表明した「iPhoneの写真・メッセージスキャン」については社内からも懸念の声が挙がっている

2021年8月5日、Appleは児童の性的搾取に関するデータ(CSAM)の拡散を防ぐための施策として、iPhoneの写真やメッセージをスキャンし、該当するコンテンツが存在しないかをチェックする施策を発表しました。これに対して一部の団体などから「ユーザーのセキュリティとプライバシーを損なう」という抗議の声が挙がっていたのですが、新たにロイター通信の報道からApple社内からも懸念の声が挙がっていることが判明しています。

Exclusive: Apple's child protection features spark concern within its own ranks -sources | Reuters

https://www.reuters.com/technology/exclusive-apples-child-protection-features-spark-concern-within-its-own-ranks-2021-08-12/

Apple employees express concerns about new CSAM scanning - 9to5Mac

https://9to5mac.com/2021/08/12/apple-employees-express-concerns-about-new-csam-scanning/

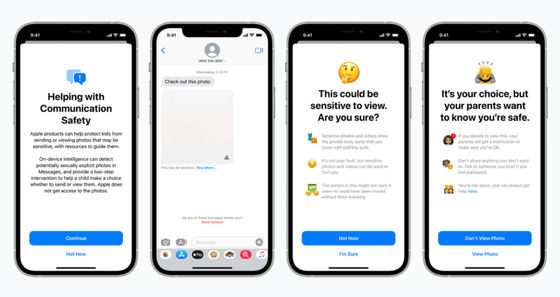

Appleが発表したCSAM拡散防止のための施策は、主に「メッセージアプリ」「iCloud写真」「Siriと検索機能」上で行われます。具体的にどのようなことが行われるのかというと、ユーザーのプライバシーを損なわない形でコンテンツを検閲したり、ユーザーがCSAMについて検索した場合に警告したり、子どもがCSAMを送信してしまった場合には親に通知したりする、というもの。各機能の詳細については、以下の記事にまとめられています。

AppleがiPhoneの写真やメッセージをスキャンして児童の性的搾取を防ぐと発表、電子フロンティア財団などから「ユーザーのセキュリティとプライバシーを損なう」という抗議の声も - GIGAZINE

AppleによるCSAM拡散防止策については、電子フロンティア財団やCenter for Democracy and Technologyといった団体から「プライバシーが損なわれる」という非難の声が挙がっていたのですが、ロイター通信によるとAppleの従業員が使用している社内用Slackチャンネルの中でも社員から懸念の声が集まっているそうです。

ロイター通信に情報を提供した匿名のApple社員によると、8月5日にAppleがCSAM拡散防止システムを発表してから、社内のSlackチャンネル上には800件以上のメッセージが寄せられ、システムの是非に関する議論が繰り広げられているとのこと。なお、多くの社員が「抑圧的な政府が、人々を検閲したり逮捕したりするためにCSAM拡散防止システムを悪用するのでは」ということを懸念しているそうです。

その後、Apple社員がCSAM拡散防止システムについて議論するための専用スレッドを作成したそうですが、一部の従業員からは「Slackはこの種の議論に最適な場所ではない」という反発の声もあった模様。なお、社内からは「違法なコンテンツを取り締まることにつながる」として、CSAM拡散防止システムを支持する声もあるそうです。

Appleは新型コロナウイルスのパンデミックにより、世界中のオフィスを閉鎖せざるを得なくなった際に、社内でSlackをより広く活用するようになりました。Appleといえば新製品などの機密情報を守るために元FBIや元シークレットサービスから構成される極秘チームを構成し、情報漏えいを徹底的に防ごうとしていることでも知られています。しかし、社内で広がったSlackの影響で「自社製品やサービスについて従業員たちがどのように考えているのかを討論する場ができあがってしまった」とApple関連メディアの9to5Macは指摘しています。

また、Appleの従業員はSlackを用いて新型コロナウイルスのパンデミック下において在宅勤務の要請を拒否されたことや、同一労働同一賃金に関する調査を行うなど、社内でのコミュニケーションが加速しているそうです。

一方で、Apple側は従業員に対して「Slack上で労働問題などのデリケートなトピックについて議論しないように」と通達しているそうですが、それでも議論を完全に抑え込むことはできていないのが現状のようです。

・関連記事

AppleがiPhoneの写真やメッセージをスキャンして児童の性的搾取を防ぐと発表、電子フロンティア財団などから「ユーザーのセキュリティとプライバシーを損なう」という抗議の声も - GIGAZINE

Appleが発表した児童の性的搾取を防ぐための「iPhoneの写真やメッセージをスキャンする取り組み」は国ごとの法律にのっとり行われる予定 - GIGAZINE

Appleが「児童性的虐待資料検出はプライバシーを損なうものではない」とFAQを発表 - GIGAZINE

・関連コンテンツ