AIの進化が止まる気配はなく、6年間で約30万倍以上の学習が可能に

人工知能(AI)を使ったコンピューターに、より正確な判断を行わせるには学習が不可欠とされています。学習の量が増えれば増えるほど、より高度な判断を行うことができるのですが、学習量を増やすためには大規模な処理をこなせる「計算量の高い」システムが必要です。AIの非営利の研究機関として設立されたOpenAIによると、AIの学習で使用される計算量は2012年から3.5カ月で倍になるスピードで進化し続けていて、2018年現在では約30万倍以上に達しているとのことです。

AI and Compute

https://blog.openai.com/ai-and-compute/

OpenAIは「アルゴリズム」「学習データ」「計算量」の3つが、AIを進歩させるために必要不可欠な要素であると述べています。アルゴリズムやデータの改良は数値化させることは困難ですが、計算量は定量化可能であり、計算量の推移を見ることでAIがどれだけ進歩しているかを見ることができるとしています。

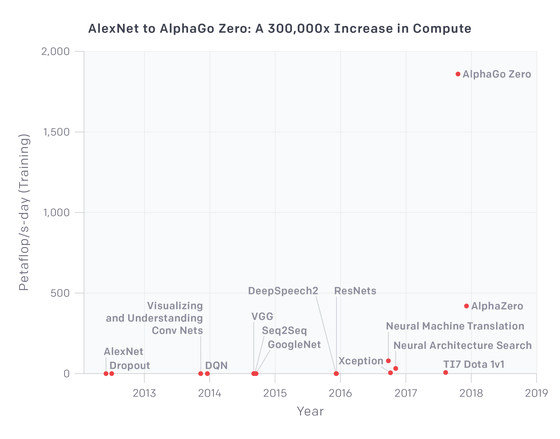

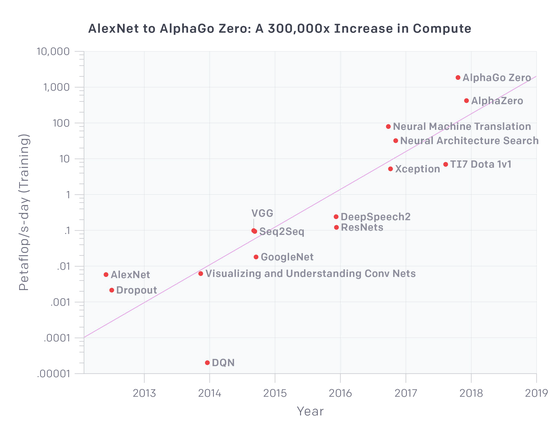

OpenAIは、2012年以降にAIの学習で使用された計算量の推移をグラフで示しています。縦軸が計算量で1日で何千兆(1015)回の計算を行うことができるかを表しており、横軸が時間軸(年)を示しています。なお、縦軸に「FLO」(浮動小数点演算)と書かれていますが、実際には処理の数であり、必ずしも浮動小数点演算を行っているわけではないとのこと。

上記のグラフでは、2017年代の「AlphaGo Zero」が、あまりにも突出した値となっており他のシステムの計算量の違いがほとんどわかりません。そこで、OpenAIは縦軸を対数スケールで示したグラフも公開しています。このグラフを見ると、2012年から登場したAIシステムの計算量が、年々右肩上がりで上昇していることがわかります。

OpenAIは、上記グラフから4つの時代を読み取ることができるとしています。

・2011年以前:当時はAIの学習にGPUが使用されることはほとんどなく、グラフに加わるレベルの計算量に達成することが困難だったようです。

・2012年~2014年:GPUを使った学習が登場します。しかしノウハウが蓄積されておらず、1台~8台までのGPUを利用して2TFLOPS(1日あたり1兆回~100兆回)の計算量を達成するので限界でした。

・2014年~2016年:この2年間で学習に使用されるGPUが10台~100台に増加します。この結果、5~10TFLOPSの計算量を達成することが可能となり、1日あたり100兆回~1京(1016)回の計算量を使って学習を行うことが可能になりました。しかし、並列処理の制約上、台数が増加するたびにGPU間の同期処理などの余分な処理が増えることになり、計算量が台数に比例して増加することはありませんでした。また、台数を増やせば増やすほどに計算量の増加が微々たるものになり、ハードウェアの数を単純に増やしても大きな効果が得られないという結果になりました。

・2016年~2017年:ハードウェアによるアプローチではなく、並列処理を行うためのアルゴリズムが見直されるようになりました。この結果、1台あたりの性能を大幅に上昇させることが可能となり、これまでの限界とされてきた計算量を上回ることができました。

そして、2018年現在は多くのハードウェア関連のスタートアップ企業が、AIに特化したチップの開発を行っており、2020年までにより安価で性能に優れた製品が数多く市場に投入されることになると予想されています。価格の低下は予算内で構築可能なシステム規模を大きくすることができ、これまで以上に大規模なシステムの構築が可能になります。このため、OpenAIはこのグラフの傾向が2018年現在から数年間は続いていくと予想しています。

・関連記事

世界最強の碁プログラム・AlphaGoの新バージョン「AlphaGo Zero」はもう自力で強くなれるレベルに到達 - GIGAZINE

完全無敵の「AlphaGo Zero」でも使われた「AIによる自己学習」の欠点とは? - GIGAZINE

Google I/Oで示された「GoogleのAI活用」まとめ、AIは日常生活の問題をどれだけ解決しているのか? - GIGAZINE

Googleが機械学習専用の第3世代プロセッサ「TPU3.0」を発表、冷却が追いつかず液冷システムまで導入する事態に - GIGAZINE

MicrosoftのAI翻訳がオフラインのアプリでも利用可能に - GIGAZINE

AIを「新しい分野」で研究すべき時期が到来している - GIGAZINE

・関連コンテンツ