Googleは「電話で人間と自然に会話をしてタスクを完了するAI」を開発している

by Iain Watson

2018年5月8日~10日の期間で開催されているGoogleの開発者向けイベント「Google I/O 2018」において、GoogleはAIを使ったさまざまな新技術を発表しました。発表された新技術の一つである「Google Duplex」はAIが電話で人間と話し、タスクを完了させるというシステムになっており、その詳細がGoogleのブログにまとめられています。

Google AI Blog: Google Duplex: An AI System for Accomplishing Real World Tasks Over the Phone

https://ai.googleblog.com/2018/05/duplex-ai-system-for-natural-conversation.html

Googleはディープラーニングにより自然な人工音声を生成するニューラルネットワーク「WaveNet」を開発し、「Googleアシスタント」に搭載するなど人工音声による人間とのやり取りに注力してきました。畳み込みニューラルネットワークによるディープラーニング技術を用いることで、かなりの精度で人間に近い自然な発声を生成することは可能になったものの、依然として「コンピューター的」な硬い口調と、砕けた口調の人間の言葉を聞き取れないという問題が残っていました。

研究チームが開発したGoogle Duplexは、「電話を通して実世界のタスクを完了させる」ことを可能にした技術であり、特定のイベントをスケジュールするといったタスクを行うことができる模様。以下の音声は上が「Google Duplexが美容院に予約を入れる音声」で、下が「Google Duplexがレストランに予約を入れる音声」です。いずれも流ちょうな英語でGoogle Duplexが店員と話しており、「電話をかけている方がGoogle Duplexだ」と知らされていなければ、人間同士のやり取りだと思ってしまいます。

研究チームはGoogle Duplexに学習させるデータと使用目的を非常に限定的な範囲に制限することで、まるで人間のような会話を実現したとのこと。Google Duplexはある特定の用途に特化した会話AIであり、世間話のような一般的な会話は不可能だそうです。

Google Duplexの技術は、「電話をかける相手」もこの形式の会話の経験を積んでいることが重要です。Google Duplexは、まず最初に「自分がコールした意図」を明確に伝え、電話相手とGoogle Duplexが共通の目的を持って会話を行うようにするとのこと。

by Linh Nguyen

人間が行う「自然な会話」は、音声認識機能を搭載したコンピューターに対して話しかける時と違い、非常に複雑な文章で話すことが多いもの。話している途中で前言を訂正したり、必要以上に同じ言葉を繰り返したり、「相手も理解しているだろう」という言葉を省略してしまったりするため、機械にとっては理解が困難になります。また、通話中のバックグラウンドノイズもAIの音声認識を難しくする要因であり、音質が悪くなるにつれてAIの「単語誤り率」が上昇するそうです。

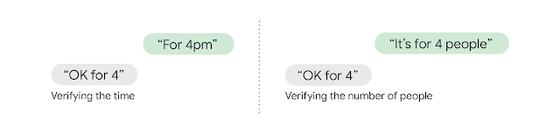

さらに、人間同士の会話が長くなると、全く同じ言葉でも別の意味を持つことがあります。たとえば「Ok for 4」という言葉がお店の予約の際に使われた場合、この「4」が「4時」という時刻を表すのか、それとも「4人」という人数を表すのかは、それまで交わした会話の文脈に左右されます。しばらく前の言葉が現在の言葉の意味に影響し、AIの処理を複雑化するというわけです。

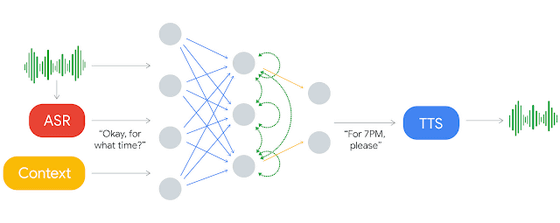

Google DuplexはGoogleの音声認識機能(ASR)で相手の音声を認識するだけでなく、それまで相手と交わした会話の履歴、会話の目的や現在の時刻といった情報をもとにして、最適な応答を作り出します。文脈をスコア化して判定し、相手の言葉が不完全であってもその意味を推測し、会話を続けることができるとのこと。自然な応答を学習させるため、AIは匿名化された電話データのコーパスを用い、応答モデルを構築しています。

また、より人間らしい自然な発声になるように、システムの処理中に「hmm(うーん)」「uh(ああ)」といった意味のない音声を発して、応答を考えていることを相手に伝えるシステムも組み込まれています。研究チームが実際の人間の会話を分析したところ、これらの意味のない声は非常に多く使われており、自然な会話を演出するのに役立つそうです。

加えて、人間は「Hello(こんにちは)」のように単純な言葉に対しては即座の応答を期待する一方、長く複雑な言葉の後に即座の応答が返ってくると不自然に感じてしまいます。そのため、処理能力を限界まで使って相手に即答するよりも、ある程度の遅延を会話に組み込む方がより「人間らしい」会話になるとのこと。

by Dave Traynor

Google Duplexは基本的に、人間の関与なしで自律的に会話を行い、タスクを完了することが可能です。一方でGoogle Duplexには自己監視機能も搭載されており、非常に複雑な予定のスケジューリングや予定外の会話など、Google Duplexでは対処しきれない状況になった場合は、人間のオペレーターに信号を送って助けを求めることができます。

ユーザーは企業への電話をかける時に、自らが企業とやり取りする必要がなく、ただGoogle Duplexとやり取りするだけでスケジュールを組むことができます。「これはユーザーの手間を減少させるだけでなく、聴覚や発話に障害を持つユーザーや、現地の言葉がわからないユーザーにとっても大きな利点となります。アクセシビリティや、言語の壁に対処するという点でも役立つだろう」と研究チームは述べています。

・関連記事

ディープラーニングで人間のような自然な音声を話す「WaveNet」がGoogleアシスタント搭載の新ハードウェアに搭載 - GIGAZINE

Googleフォトに「白黒写真に色を付ける」機能が搭載される予定 - GIGAZINE

GoogleマップがARナビゲーション機能に対応、カメラをかざすだけでナビが可能に - GIGAZINE

CIAはスパイ活動の一部をAIに置き換えることを視野に入れている - GIGAZINE

邪魔な物体を塗りつぶすだけでAIが画像を違和感ないレベルに自動修正する技術「Image Inpainting」をNVIDIAが公開 - GIGAZINE

人工知能の第一人者が語る「人工知能が持つ可能性と危険性」とは? - GIGAZINE

・関連コンテンツ