AppleがiPhoneやiPadでローカルに動作するオープンソースの言語モデル「OpenELM」をリリース

Appleの研究チームが、オープンソースの言語モデル「OpenELM(Open-source Efficient Language Models)」を公開しました。公開されたモデルにはAppleデバイスで動作できるように変換するコードも用意されており、「言語モデルをAppleデバイス上でローカルに実行させる」ことが可能になっています。

[2404.14619] OpenELM: An Efficient Language Model Family with Open-source Training and Inference Framework

https://arxiv.org/abs/2404.14619

OpenELM: An Efficient Language Model Family with Open-source Training and Inference Framework - Apple Machine Learning Research

https://machinelearning.apple.com/research/openelm

公開されたOpenELMは270M(パラメーター数:2億7000万)、450M(パラメーター数:4億5000万)、1_1B(パラメーター数:11億)、3B(パラメーター数:30億)の4モデルが用意されています。OpenAIのGPT-4やAnthropicのClaude 3、MetaのLlama 3と比較すると、OpenELMは比較的小規模なモデルですが、小規模ゆえに実行コストが低く、スマートフォンやノートPCでも動作するように最適化されています。

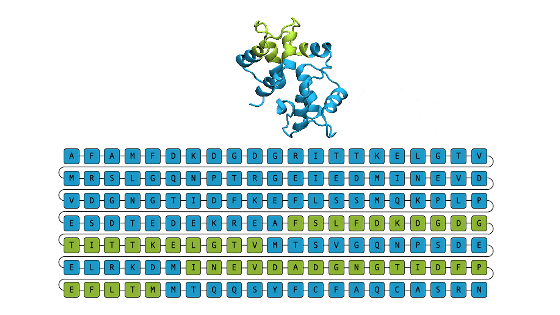

OpenELMの特徴の1つが、Transformerの各レイヤーにおけるパラメーター数を変化させることでモデル全体のパラメーターを効率的に配分する「layer-wise scaling」という手法を採用していることです。

具体的には、入力に近いレイヤーではアテンションやフィードフォワードのための潜在パラメーターの次元を小さくし、出力に近づくにつれて徐々にレイヤーを広げていきます。これにより、限られたパラメータ数の中で、各レイヤーに適切な数のパラメータを割り当てることができます。従来の言語モデルでは、全てのレイヤーで同じ設定を持つことが一般的でしたが、このlayer-wise scalingによってレイヤーごとに異なる設定を行い、パラメーターをより効果的に活用することが可能になります。

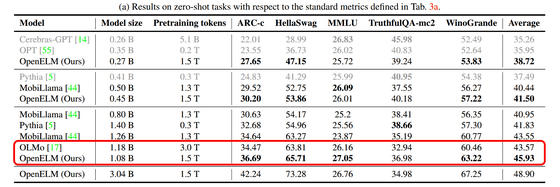

研究チームによれば、公開データセットのみで学習したところ、OpenELMは同程度のパラメーター数のオープンモデルと比較して高い精度を達成したと報告しています。例えば、約11億のパラメーターを持つOpenELMは、約12億のパラメーターを持つOLMoというモデルに比べ、必要だった学習データ量がOLMoの半分であったにもかかわらず、精度が2.36%高かったそうです。

また、言語モデルに特定のタスクを行うための指示を与え、そのタスクに特化した学習を行う「Instruction Tuning」を適用することで、OpenELMの精度が1〜2%向上したとのこと。研究チームは、Instruction Tuningを適用することで、OpenELMは汎用的な言語理解能力だけでなく、特定のタスクにおける性能も向上したと報告しました。加えて、OpenELMはLow-Rank Adaptation(LoRA)やDecomposed Low-Rank Adaptation(LoRA)など、パラメーター効率のいいファインチューニング(微調整)を行う方法が適用可能になっているとのこと。

さらに、学習したモデルをAppleのMLX(Machine Learning Accelerator)ライブラリに変換するためのコードも提供されています。つまり、学習したOpenELMモデルをiPhoneやiPadなどのAppleデバイス上で効率的に動作させることが可能になります。

OpenELMはオープンソースで開発されており、オンラインAIプラットフォームのHugging Faceにリポジトリがホストされています。研究チームはOpenELMの再現性や透明性を確保するため、OpenELMモデルのウェイトだけでなく、学習コードや学習ログ、複数のチェックポイント、モデルの学習に使用した公開データセット、学習の詳細なハイパーパラメータ、MLXライブラリに変換するコードも提供しています。

apple/OpenELM · Hugging Face

https://huggingface.co/apple/OpenELM

AppleはこのOpenELMを今後どのように展開していくのかを明らかにしていませんが、IT系ニュースサイトのThe Vergeは「メールの文面作成などテキスト関連のタスクをAppleデバイス上で効率的に実行する」可能性に期待しています。

・関連記事

AppleはAIに最適化した「M4チップ」を2024年中にリリースすることを目指している - GIGAZINE

Appleがスマホの画面を認識できるマルチモーダルLLM「Ferret-UI」を発表、SiriがiPhoneアプリのUIを理解できるようになる可能性も - GIGAZINE

Appleが中国の百度(Baidu)と「生成AI技術の使用」について協議を重ねている - GIGAZINE

AppleがiPhone向けのAI機能を強化するべくGoogleのGeminiを採用するとの報道 - GIGAZINE

Appleがひっそり買収していたAIスタートアップの「DarwinAI」はどんなテクノロジーを有していたのか? - GIGAZINE

AppleがAI開発に多額の投資を行っていることを明かし「2024年後半に詳細を明らかにする」と話す - GIGAZINE

Appleがプロンプトを入力するだけで静止画をアニメーション化してくれるAIツール「Keyframer」を発表 - GIGAZINE

・関連コンテンツ